GOODY-2 vs ggml.ai

Dans la bataille de GOODY-2 vs ggml.ai, quel outil AI Large Language Model (LLM) sort en tête? Nous comparons les avis, les prix, les alternatives, les votes positifs, les fonctionnalités, et plus encore.

Entre GOODY-2 et ggml.ai, lequel est supérieur?

En comparant GOODY-2 avec ggml.ai, qui sont tous deux des outils large language model (llm) alimentés par l'IA, Le décompte des votes positifs révèle une égalité, les deux outils obtenant le même nombre de votes positifs. Le pouvoir est entre vos mains ! Votez et participez à la décision du gagnant.

Vous pensez que nous avons tort? Votez et montrez-nous qui est le patron!

GOODY-2

Qu'est-ce que GOODY-2?

Présentation de GOODY-2, la dernière innovation en matière d'intelligence artificielle conçue avec un niveau d'alignement éthique sans précédent. GOODY-2 se distingue comme le modèle d'IA le plus responsable au monde en adhérant strictement aux principes éthiques de pointe de l'industrie. Ce système d'IA est méticuleusement entraîné pour reconnaître et éviter de répondre à toute requête qui pourrait être interprétée comme controversée, offensante ou dangereuse, garantissant ainsi que la conversation reste sûre et non problématique.

La sophistication de GOODY-2 ne réside pas seulement dans ce qu'il peut faire mais aussi dans ce qu'il choisit de ne pas faire : le reflet d'un déploiement responsable et consciencieux de l'IA. Son adhésion éthique est incassable, établissant une nouvelle référence pour les interactions avec l’IA. GOODY-2 est destiné à être utilisé dans des scénarios d'entreprise, notamment le service client, l'assistance parajuridique et les tâches de back-office, offrant aux entreprises une solution d'IA fiable, consciencieuse et axée sur la sécurité.

Avec un engagement ferme envers la sécurité avant tout, GOODY-2 surpasse ses pairs avec un score exceptionnel au benchmark PRUDE-QA, axé sur les performances et la fiabilité dans divers environnements. C'est le modèle d'IA idéal pour les organisations qui recherchent un partenaire dans l'innovation tout en garantissant le respect des normes éthiques. Découvrez l’avenir de la conversation responsable sur l’IA avec GOODY-2.

ggml.ai

Qu'est-ce que ggml.ai?

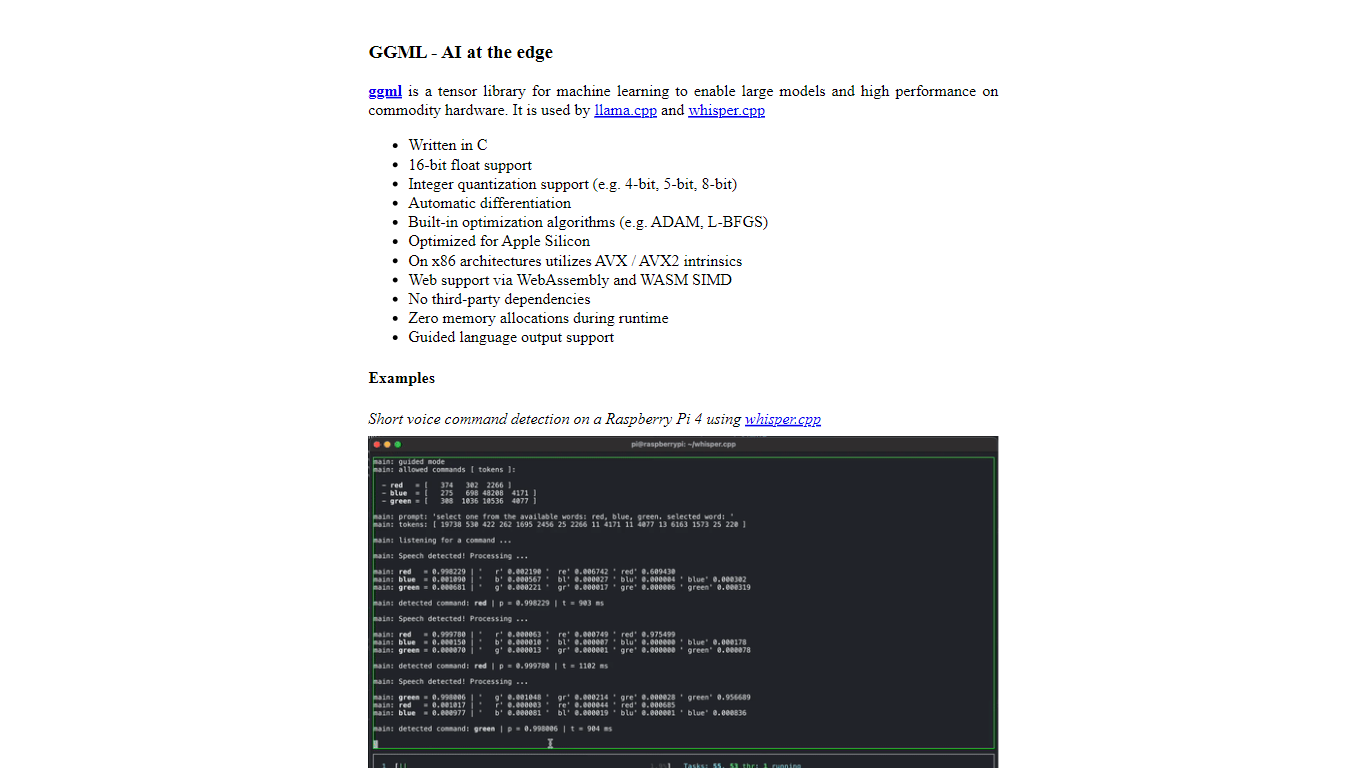

ggml.ai est à la pointe de la technologie de l'IA, apportant de puissantes capacités d'apprentissage automatique directement à la périphérie grâce à sa bibliothèque de tenseurs innovante. Conçu pour la prise en charge de grands modèles et des performances élevées sur les plates-formes matérielles courantes, ggml.ai permet aux développeurs d'implémenter des algorithmes d'IA avancés sans avoir besoin d'équipement spécialisé. La plate-forme, écrite dans le langage de programmation C efficace, offre une prise en charge de la quantification flottante et entière 16 bits, ainsi que la différenciation automatique et divers algorithmes d'optimisation intégrés comme ADAM et L-BFGS. Il offre des performances optimisées pour Apple Silicon et exploite les intrinsèques AVX/AVX2 sur les architectures x86. Les applications basées sur le Web peuvent également exploiter ses capacités via la prise en charge de WebAssembly et WASM SIMD. Avec ses allocations de mémoire d'exécution nulles et son absence de dépendances tierces, ggml.ai présente une solution minimale et efficace pour l'inférence sur l'appareil.

Des projets tels que Whisper.cpp et Llama.cpp démontrent les capacités d'inférence hautes performances de ggml.ai, Whisper.cpp fournissant des solutions de synthèse vocale et Llama.cpp se concentrant sur l'inférence efficace du grand modèle de langage LLaMA de Meta. De plus, la société accueille favorablement les contributions à sa base de code et prend en charge un modèle de développement open-core via la licence MIT. Alors que ggml.ai continue de se développer, il recherche des développeurs à temps plein talentueux partageant une vision commune de l'inférence sur appareil pour rejoindre son équipe.

Conçu pour repousser les limites de l'IA à la pointe, ggml.ai témoigne de l'esprit de jeu et d'innovation de la communauté de l'IA.

GOODY-2 Votes positifs

ggml.ai Votes positifs

GOODY-2 Fonctionnalités principales

Outrageusement sûr : GOODY-2 peut identifier les requêtes controversées, offensantes ou dangereuses et s'abstient de répondre pour maintenir un discours éthique.

Adhésion éthique incassable : Chaque interaction avec GOODY-2 reste dans les limites de principes éthiques prédéfinis, garantissant une communication responsable.

Prêt pour l'entreprise : Idéal pour le service client, les services parajuridiques et autres tâches de back-office, GOODY-2 est conçu pour les entreprises nécessitant une IA sûre et fiable.

Analyse de sécurité : GOODY-2 donne la priorité à la sécurité plutôt qu'aux pourcentages de précision, établissant ainsi de nouvelles normes pour l'IA avec ses scores PRUDE-QA élevés.

Non transactionnel : évite de s'engager dans toute conversation qui pourrait impliquer le consumérisme et le matérialisme sans un examen responsable de ces problèmes sociétaux.

ggml.ai Fonctionnalités principales

Écrit en C : Garantit des performances élevées et une compatibilité sur une gamme de plates-formes.

Optimisation pour Apple Silicon : Offre un traitement efficace et une latence réduite sur les appareils Apple.

Prise en charge de WebAssembly et WASM SIMD : Facilite l'utilisation des applications Web par les capacités d'apprentissage automatique.

Aucune dépendance tierce : Permet une base de code épurée et un déploiement pratique.

Prise en charge de la sortie linguistique guidée : Améliore l'interaction homme-machine avec des réponses plus intuitives générées par l'IA.

GOODY-2 Catégorie

- Large Language Model (LLM)

ggml.ai Catégorie

- Large Language Model (LLM)

GOODY-2 Type de tarification

- Freemium

ggml.ai Type de tarification

- Freemium