Dernière mise à jour 10-23-2025

Catégorie:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

ggml.ai

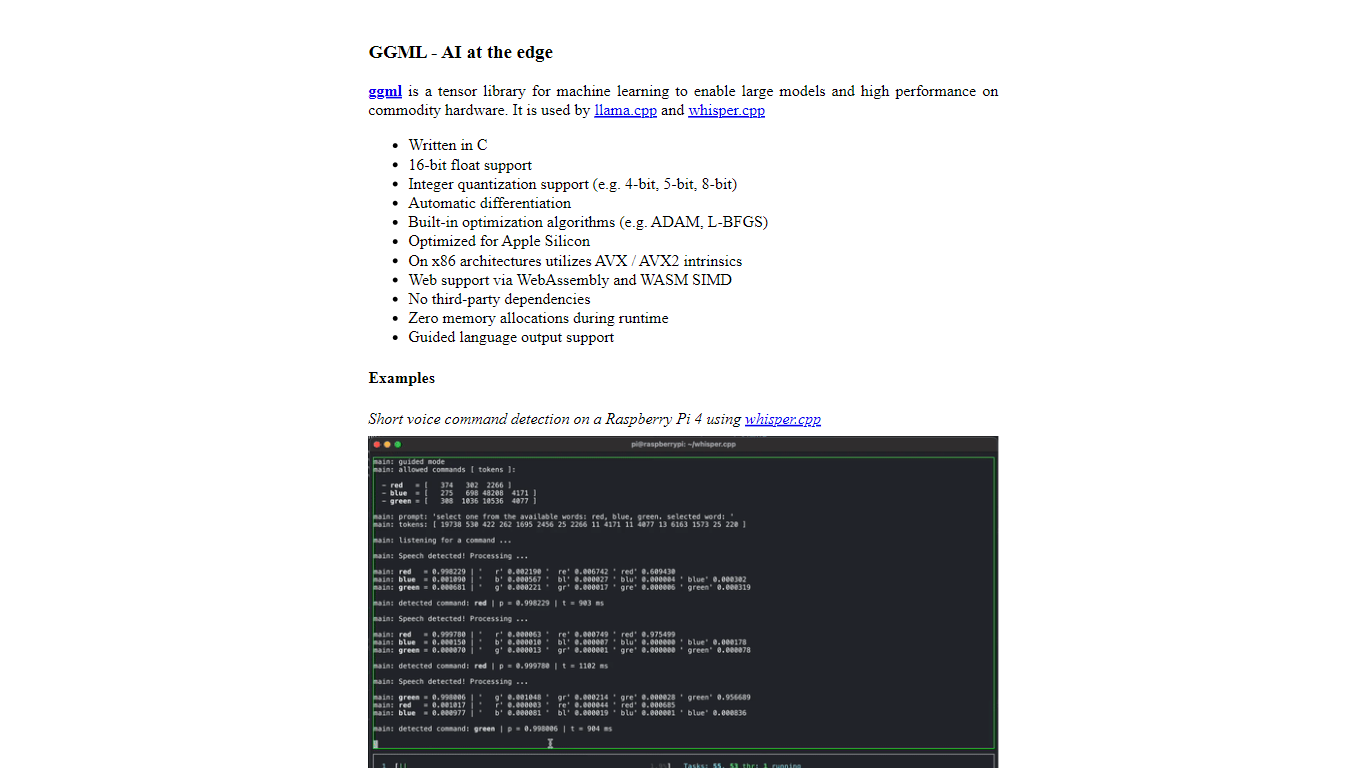

ggml.ai est à la pointe de la technologie de l'IA, apportant de puissantes capacités d'apprentissage automatique directement à la périphérie grâce à sa bibliothèque de tenseurs innovante. Conçu pour la prise en charge de grands modèles et des performances élevées sur les plates-formes matérielles courantes, ggml.ai permet aux développeurs d'implémenter des algorithmes d'IA avancés sans avoir besoin d'équipement spécialisé. La plate-forme, écrite dans le langage de programmation C efficace, offre une prise en charge de la quantification flottante et entière 16 bits, ainsi que la différenciation automatique et divers algorithmes d'optimisation intégrés comme ADAM et L-BFGS. Il offre des performances optimisées pour Apple Silicon et exploite les intrinsèques AVX/AVX2 sur les architectures x86. Les applications basées sur le Web peuvent également exploiter ses capacités via la prise en charge de WebAssembly et WASM SIMD. Avec ses allocations de mémoire d'exécution nulles et son absence de dépendances tierces, ggml.ai présente une solution minimale et efficace pour l'inférence sur l'appareil.

Des projets tels que Whisper.cpp et Llama.cpp démontrent les capacités d'inférence hautes performances de ggml.ai, Whisper.cpp fournissant des solutions de synthèse vocale et Llama.cpp se concentrant sur l'inférence efficace du grand modèle de langage LLaMA de Meta. De plus, la société accueille favorablement les contributions à sa base de code et prend en charge un modèle de développement open-core via la licence MIT. Alors que ggml.ai continue de se développer, il recherche des développeurs à temps plein talentueux partageant une vision commune de l'inférence sur appareil pour rejoindre son équipe.

Conçu pour repousser les limites de l'IA à la pointe, ggml.ai témoigne de l'esprit de jeu et d'innovation de la communauté de l'IA.

Écrit en C : Garantit des performances élevées et une compatibilité sur une gamme de plates-formes.

Optimisation pour Apple Silicon : Offre un traitement efficace et une latence réduite sur les appareils Apple.

Prise en charge de WebAssembly et WASM SIMD : Facilite l'utilisation des applications Web par les capacités d'apprentissage automatique.

Aucune dépendance tierce : Permet une base de code épurée et un déploiement pratique.

Prise en charge de la sortie linguistique guidée : Améliore l'interaction homme-machine avec des réponses plus intuitives générées par l'IA.

Qu’est-ce que ggml.ai ?

ggml.ai est une bibliothèque de tenseurs pour l'apprentissage automatique qui facilite l'utilisation de grands modèles et de calculs hautes performances sur du matériel standard.

ggml.ai est-il optimisé pour un matériel spécifique ?

Il est conçu dans un souci d'optimisation pour Apple Silicon, mais prend également en charge les architectures x86 utilisant les intrinsèques AVX/AVX2.

Quels projets sont associés à ggml.ai ?

Les projets ggml.ai incluent murmur.cpp pour l'inférence haute performance du modèle Whisper d'OpenAI et llama.cpp pour l'inférence du modèle LLaMA de Meta.

Puis-je contribuer à ggml.ai ?

Oui, les individus et les entités peuvent contribuer à ggml.ai soit en élargissant la base de code, soit en parrainant financièrement les contributeurs.

Comment puis-je contacter ggml.ai pour des demandes de renseignements commerciales ou des contributions ?

Les demandes commerciales doivent être adressées à [email protected], et les personnes intéressées à contribuer ou à rechercher un emploi doivent contacter [email protected].