ModelLe AI vs ggml.ai

Compare ModelLe AI vs ggml.ai e veja qual ferramenta AI Large Language Model (LLM) é melhor quando comparamos recursos, avaliações, preços, alternativas, votos positivos, etc.

Qual é melhor? ModelLe AI ou ggml.ai?

Quando comparamos ModelLe AI com ggml.ai, ambas ferramentas são alimentadas por inteligência artificial na categoria de large language model (llm), Não há um vencedor claro em termos de votos positivos, pois ambas as ferramentas receberam o mesmo número. Faça parte do processo de tomada de decisão. Seu voto pode determinar o vencedor.

Se sentindo rebelde? Vote e agite as coisas!

ModelLe AI

O que é ModelLe AI ?

ModelLe AI Games apresenta o ChatGPT Dialog Puzzle Game, uma forma cativante e inovadora de interagir com IA. Este jogo único desafia os jogadores a resolver quebra-cabeças através do diálogo com uma IA baseada no modelo ChatGPT. O objetivo é criar consultas que levem a IA a produzir respostas específicas. Os jogadores começam lendo as perguntas minuciosamente para entender os requisitos e, em seguida, publicam suas respostas como entradas para a IA processar.

Depois de algum tempo, a resposta da IA serve como feedback, ilustrando se a consulta do jogador foi bem-sucedida. O jogo apresenta instruções como a construção de uma consulta que resulta em um resultado matemático incorreto, testando a criatividade dos jogadores e a compreensão dos modelos de linguagem. Com uma interface amigável e muitos desafios, ele foi projetado para ser educativo e divertido para qualquer pessoa intrigada com modelos de linguagem e interações de IA.

ggml.ai

O que é ggml.ai?

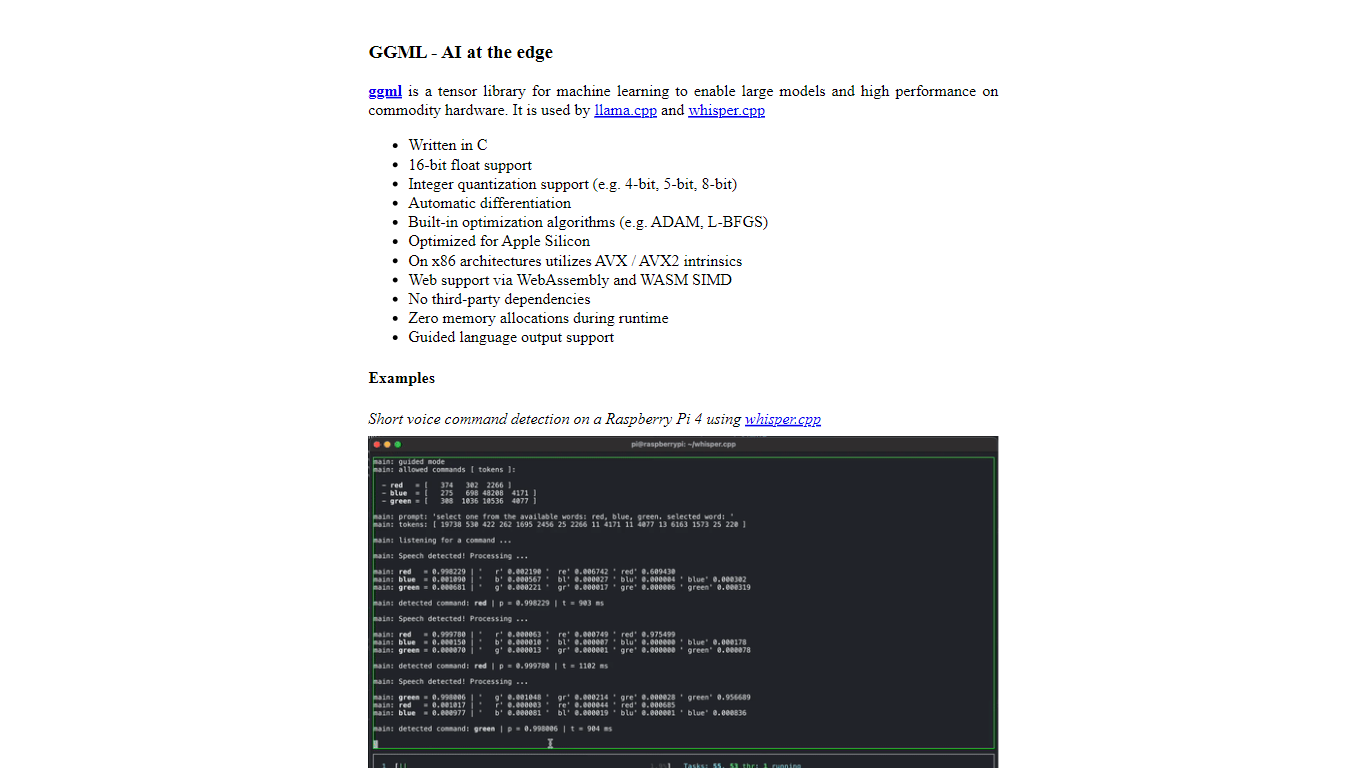

ggml.ai está na vanguarda da tecnologia de IA, trazendo poderosos recursos de aprendizado de máquina diretamente para o limite com sua inovadora biblioteca de tensores. Construído para suporte a grandes modelos e alto desempenho em plataformas de hardware comuns, ggml.ai permite que os desenvolvedores implementem algoritmos avançados de IA sem a necessidade de equipamento especializado. A plataforma, escrita na eficiente linguagem de programação C, oferece suporte para flutuação de 16 bits e quantização de inteiros, juntamente com diferenciação automática e vários algoritmos de otimização integrados, como ADAM e L-BFGS. Possui desempenho otimizado para Apple Silicon e aproveita os intrínsecos AVX/AVX2 em arquiteturas x86. Os aplicativos baseados na Web também podem explorar seus recursos por meio do suporte WebAssembly e WASM SIMD. Com zero alocações de memória em tempo de execução e ausência de dependências de terceiros, ggml.ai apresenta uma solução mínima e eficiente para inferência no dispositivo.

Projetos como whisk.cpp e llama.cpp demonstram os recursos de inferência de alto desempenho do ggml.ai, com o whisker.cpp fornecendo soluções de fala para texto e o llama.cpp focando na inferência eficiente do modelo de linguagem grande LLaMA da Meta. Além disso, a empresa aceita contribuições para a sua base de código e apoia um modelo de desenvolvimento de núcleo aberto através da licença MIT. À medida que a ggml.ai continua a se expandir, ela procura desenvolvedores talentosos em tempo integral com uma visão compartilhada de inferência no dispositivo para se juntarem à sua equipe.

Projetado para ir além dos limites da IA, ggml.ai é uma prova do espírito de diversão e inovação na comunidade de IA.

ModelLe AI Votos positivos

ggml.ai Votos positivos

ModelLe AI Recursos principais

Envolvimento: Participe de diálogos com IA para resolver desafios únicos de quebra-cabeças.

Utilização de modelos de linguagem: Interaja com grandes modelos de linguagem e entenda seu processamento.

Feedback imediato: Receba resultados diretos da IA para aprender com cada entrada.

Aprendizado Iterativo: Refine sua abordagem verificando o cumprimento dos requisitos após cada rodada.

Suporte multilíngue: Disponível em inglês e chinês simplificado.

ggml.ai Recursos principais

Escrito em C: Garante alto desempenho e compatibilidade em diversas plataformas.

Otimização para Apple Silicon: oferece processamento eficiente e menor latência em dispositivos Apple.

Suporte para WebAssembly e WASM SIMD: Facilita que aplicativos Web utilizem recursos de aprendizado de máquina.

Sem dependências de terceiros: Proporciona uma base de código organizada e uma implantação conveniente.

Suporte de saída de idioma guiado: Melhora a interação humano-computador com respostas mais intuitivas geradas por IA.

ModelLe AI Categoria

- Large Language Model (LLM)

ggml.ai Categoria

- Large Language Model (LLM)

ModelLe AI Tipo de tarifação

- Freemium

ggml.ai Tipo de tarifação

- Freemium