Última atualização 10-23-2025

Categoria:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

ggml.ai

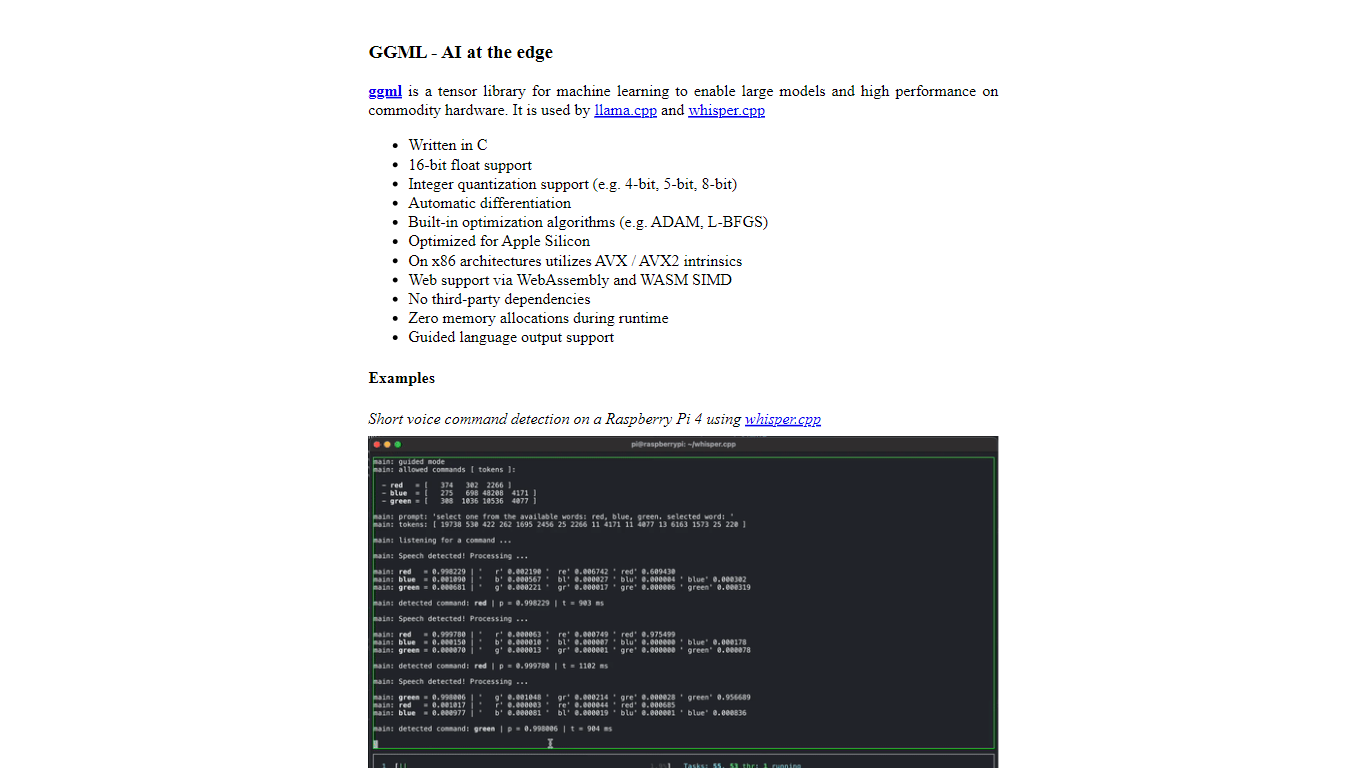

ggml.ai está na vanguarda da tecnologia de IA, trazendo poderosos recursos de aprendizado de máquina diretamente para o limite com sua inovadora biblioteca de tensores. Construído para suporte a grandes modelos e alto desempenho em plataformas de hardware comuns, ggml.ai permite que os desenvolvedores implementem algoritmos avançados de IA sem a necessidade de equipamento especializado. A plataforma, escrita na eficiente linguagem de programação C, oferece suporte para flutuação de 16 bits e quantização de inteiros, juntamente com diferenciação automática e vários algoritmos de otimização integrados, como ADAM e L-BFGS. Possui desempenho otimizado para Apple Silicon e aproveita os intrínsecos AVX/AVX2 em arquiteturas x86. Os aplicativos baseados na Web também podem explorar seus recursos por meio do suporte WebAssembly e WASM SIMD. Com zero alocações de memória em tempo de execução e ausência de dependências de terceiros, ggml.ai apresenta uma solução mínima e eficiente para inferência no dispositivo.

Projetos como whisk.cpp e llama.cpp demonstram os recursos de inferência de alto desempenho do ggml.ai, com o whisker.cpp fornecendo soluções de fala para texto e o llama.cpp focando na inferência eficiente do modelo de linguagem grande LLaMA da Meta. Além disso, a empresa aceita contribuições para a sua base de código e apoia um modelo de desenvolvimento de núcleo aberto através da licença MIT. À medida que a ggml.ai continua a se expandir, ela procura desenvolvedores talentosos em tempo integral com uma visão compartilhada de inferência no dispositivo para se juntarem à sua equipe.

Projetado para ir além dos limites da IA, ggml.ai é uma prova do espírito de diversão e inovação na comunidade de IA.

Escrito em C: Garante alto desempenho e compatibilidade em diversas plataformas.

Otimização para Apple Silicon: oferece processamento eficiente e menor latência em dispositivos Apple.

Suporte para WebAssembly e WASM SIMD: Facilita que aplicativos Web utilizem recursos de aprendizado de máquina.

Sem dependências de terceiros: Proporciona uma base de código organizada e uma implantação conveniente.

Suporte de saída de idioma guiado: Melhora a interação humano-computador com respostas mais intuitivas geradas por IA.

O que é gml.ai?

ggml.ai é uma biblioteca de tensores para aprendizado de máquina que facilita o uso de modelos grandes e cálculos de alto desempenho em hardware comum.

O ggml.ai está otimizado para algum hardware específico?

Ele foi projetado com a otimização para Apple Silicon em mente, mas também suporta arquiteturas x86 usando intrínsecos AVX/AVX2.

Quais projetos estão associados ao ggml.ai?

Os projetos ggml.ai incluem Whisper.cpp para inferência de alto desempenho do modelo Whisper da OpenAI e llama.cpp para inferência do modelo LLaMA da Meta.

Posso contribuir com ggml.ai?

Sim, indivíduos e entidades podem contribuir para ggml.ai expandindo a base de código ou patrocinando financeiramente os contribuidores.

Como posso entrar em contato com ggml.ai para consultas comerciais ou contribuições?

Consultas comerciais devem ser direcionadas para [email protected], e indivíduos interessados em contribuir ou procurar emprego devem entrar em contato com [email protected].