Terracotta vs ggml.ai

Explore o confronto entre Terracotta vs ggml.ai e descubra qual ferramenta AI Large Language Model (LLM) vence. Analisamos votos positivos, recursos, avaliações, preços, alternativas e muito mais.

Ao comparar Terracotta e ggml.ai, qual se destaca?

Ao contrastar Terracotta com ggml.ai, ambas são ferramentas excepcionais operadas por inteligência artificial na categoria de large language model (llm), e ao colocá-las lado a lado, podemos notar várias semelhanças e divergências cruciais. Ambas as ferramentas são igualmente favorecidas, como indicado pelo mesmo número de votos positivos. Cada voto conta! Vote e contribua para a decisão do vencedor.

Não concorda com o resultado? Vote e faça parte do processo de tomada de decisão!

Terracotta

O que é Terracotta?

Terracotta é uma plataforma de ponta projetada para aprimorar o fluxo de trabalho para desenvolvedores e pesquisadores que trabalham com grandes modelos de linguagem (LLMs). Esta plataforma intuitiva e fácil de usar permite gerenciar, iterar e avaliar seus modelos ajustados com facilidade. Com o Terracotta, você pode fazer upload de dados com segurança, ajustar modelos para diversas tarefas, como classificação e geração de texto, e criar avaliações abrangentes para comparar o desempenho do modelo usando métricas qualitativas e quantitativas. Nossa ferramenta oferece suporte a conexões com grandes provedores como OpenAI e Cohere, garantindo que você tenha acesso a uma ampla gama de recursos de LLM. Terracotta é criação de Beri Kohen e Lucas Pauker, entusiastas de IA e graduados em Stanford, que se dedicam a promover o desenvolvimento de LLM. Cadastre-se em nossa lista de e-mail para se manter informado sobre as últimas atualizações e recursos que o Terracotta tem a oferecer.

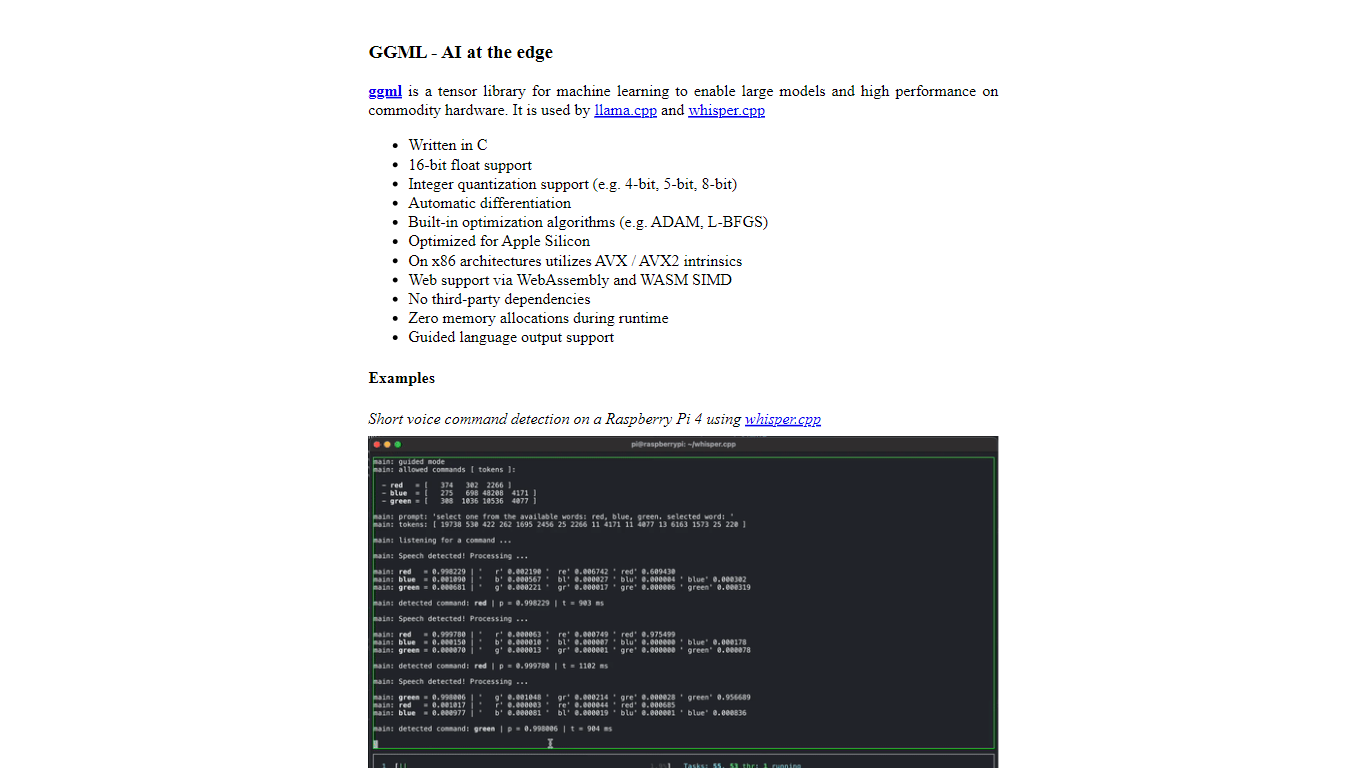

ggml.ai

O que é ggml.ai?

ggml.ai está na vanguarda da tecnologia de IA, trazendo poderosos recursos de aprendizado de máquina diretamente para o limite com sua inovadora biblioteca de tensores. Construído para suporte a grandes modelos e alto desempenho em plataformas de hardware comuns, ggml.ai permite que os desenvolvedores implementem algoritmos avançados de IA sem a necessidade de equipamento especializado. A plataforma, escrita na eficiente linguagem de programação C, oferece suporte para flutuação de 16 bits e quantização de inteiros, juntamente com diferenciação automática e vários algoritmos de otimização integrados, como ADAM e L-BFGS. Possui desempenho otimizado para Apple Silicon e aproveita os intrínsecos AVX/AVX2 em arquiteturas x86. Os aplicativos baseados na Web também podem explorar seus recursos por meio do suporte WebAssembly e WASM SIMD. Com zero alocações de memória em tempo de execução e ausência de dependências de terceiros, ggml.ai apresenta uma solução mínima e eficiente para inferência no dispositivo.

Projetos como whisk.cpp e llama.cpp demonstram os recursos de inferência de alto desempenho do ggml.ai, com o whisker.cpp fornecendo soluções de fala para texto e o llama.cpp focando na inferência eficiente do modelo de linguagem grande LLaMA da Meta. Além disso, a empresa aceita contribuições para a sua base de código e apoia um modelo de desenvolvimento de núcleo aberto através da licença MIT. À medida que a ggml.ai continua a se expandir, ela procura desenvolvedores talentosos em tempo integral com uma visão compartilhada de inferência no dispositivo para se juntarem à sua equipe.

Projetado para ir além dos limites da IA, ggml.ai é uma prova do espírito de diversão e inovação na comunidade de IA.

Terracotta Votos positivos

ggml.ai Votos positivos

Terracotta Recursos principais

Gerencie vários modelos: Gerencie centralmente todos os seus modelos ajustados em um local conveniente.

Iterar rapidamente: Simplifique o processo de melhoria do modelo com avaliações qualitativas e quantitativas rápidas.

Vários provedores: Integre-se perfeitamente aos serviços da OpenAI e Cohere para turbinar seu processo de desenvolvimento.

Carregue seus dados: carregue e armazene com segurança seus conjuntos de dados para o ajuste fino de modelos.

Crie avaliações: conduza avaliações comparativas aprofundadas do desempenho do modelo, aproveitando métricas como precisão BLEU e matrizes de confusão.

ggml.ai Recursos principais

Escrito em C: Garante alto desempenho e compatibilidade em diversas plataformas.

Otimização para Apple Silicon: oferece processamento eficiente e menor latência em dispositivos Apple.

Suporte para WebAssembly e WASM SIMD: Facilita que aplicativos Web utilizem recursos de aprendizado de máquina.

Sem dependências de terceiros: Proporciona uma base de código organizada e uma implantação conveniente.

Suporte de saída de idioma guiado: Melhora a interação humano-computador com respostas mais intuitivas geradas por IA.

Terracotta Categoria

- Large Language Model (LLM)

ggml.ai Categoria

- Large Language Model (LLM)

Terracotta Tipo de tarifação

- Freemium

ggml.ai Tipo de tarifação

- Freemium