StabilityAI's Stable Diffusion v2-1 vs Drag Your GAN

Mergulhe na comparação entre StabilityAI's Stable Diffusion v2-1 vs Drag Your GAN e descubra qual ferramenta AI Image Generation Model se destaca. Examinamos alternativas, votos positivos, recursos, avaliações, preços e muito mais.

Ao comparar StabilityAI's Stable Diffusion v2-1 e Drag Your GAN, qual se destaca?

Ao comparar StabilityAI's Stable Diffusion v2-1 e Drag Your GAN, duas ferramentas excepcionais da categoria de image generation model alimentadas por inteligência artificial, e colocá-las lado a lado, várias semelhanças e diferenças-chave se destacam. Na corrida pelos votos positivos, Drag Your GAN leva o troféu. Drag Your GAN recebeu 8 votos positivos dos usuários da aitools.fyi, enquanto StabilityAI's Stable Diffusion v2-1 recebeu 6 votos positivos.

Você não concorda com o resultado? Vote para nos ajudar a decidir!

StabilityAI's Stable Diffusion v2-1

O que é StabilityAI's Stable Diffusion v2-1?

Embarque em uma jornada inovadora com a Stabilityai, onde a fusão de código aberto e ciência aberta impulsiona a democratização da inteligência artificial. Descubra o modelo estável de difusão V2-1, rigorosamente ajustado e pronto para capacitar seus esforços criativos e de pesquisa de maneiras sem precedentes. Mergulhe no mundo da geração de texto para imagem, onde seus avisos ganham vida através de imagens vívidas sintetizadas por modelos de difusão avançada.

Inve-se nos meandros da difusão estável v2-1, criada por uma equipe de especialistas como Robin Rombach e Patrick Esser. Aproveitando um modelo de difusão latente equipado com um codificador de texto pré -treinado, esta AI Marvel permite explorar os reinos da criação artística, a implantação segura de conteúdo e o entendimento dos vieses e limitações da IA. Pronto para se envolver com o poder transformador da IA? Conecte-se com o modelo de difusão estável V2-1 da StabilityAai hoje.

Drag Your GAN

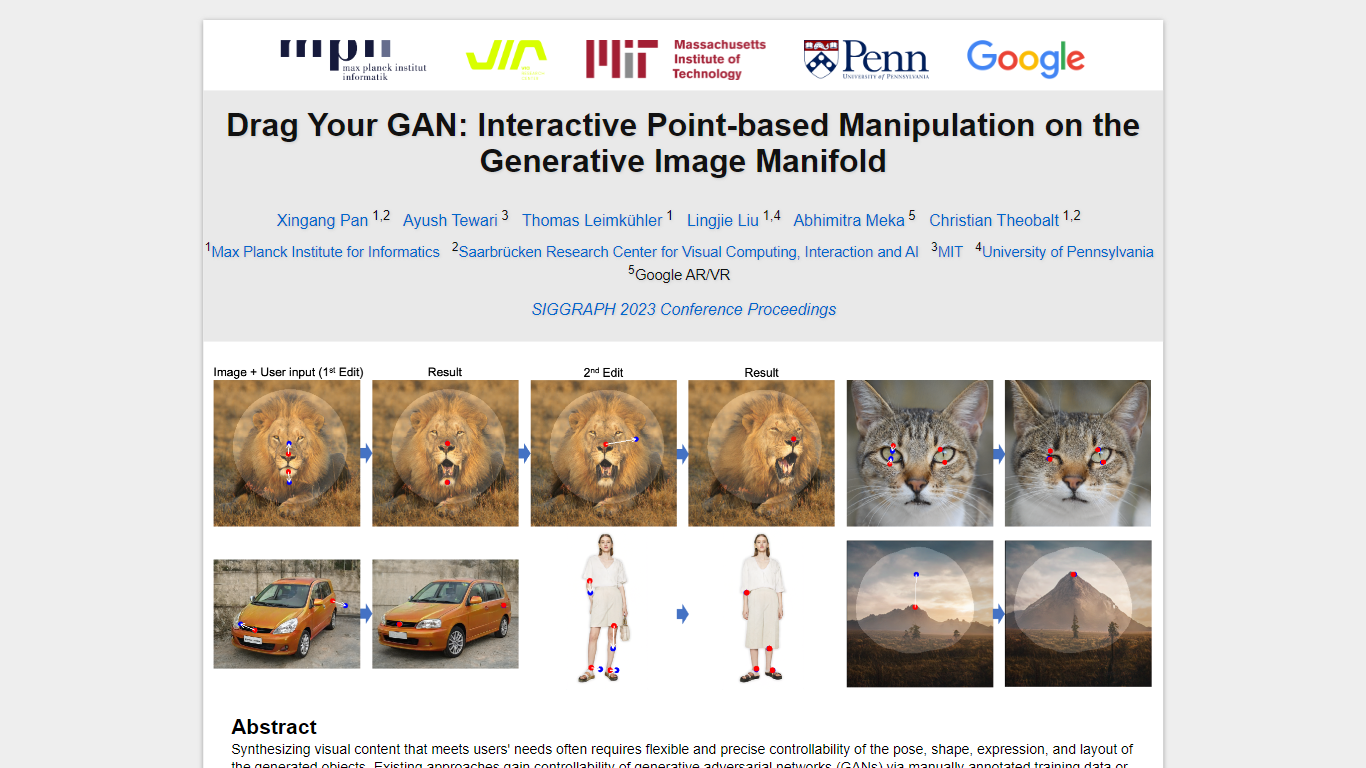

O que é Drag Your GAN?

No campo de sintetizar conteúdo visual para atender às necessidades dos usuários, é essencial alcançar um controle preciso sobre pose, forma, expressão e layout de objetos gerados. As abordagens tradicionais para controlar redes adversárias generativas (GANs) se basearam em anotações manuais durante o treinamento ou modelos 3D anteriores, geralmente sem flexibilidade, precisão e versatilidade necessárias para diversas aplicações.

Em nossa pesquisa, exploramos um método inovador e relativamente desconhecido para o controle da GaN-a capacidade de "arrastar" pontos de imagem específicos para atingir com precisão os pontos de destino definidos pelo usuário de maneira interativa (conforme ilustrado na Fig.1). Essa abordagem levou ao desenvolvimento de Draggan, uma nova estrutura que compreende dois componentes principais:

Supervisão de movimento baseada em recursos: este componente guia os pontos da imagem em direção às posições do alvo pretendido por meio de supervisão de movimento baseado em recursos.

Rastreamento de pontos: alavancando os recursos discriminativos do GAN, nossa nova técnica de rastreamento de pontos localiza continuamente a posição dos pontos de alça.

O Draggan capacita os usuários a deformar imagens com precisão notável, permitindo a manipulação da pose, forma, expressão e layout em diversas categorias como animais, carros, humanos, paisagens e muito mais. Essas manipulações ocorrem dentro do coletor de imagem generativo instruído de um GaN, resultando em saídas realistas, mesmo em cenários complexos, como gerar conteúdo ocluído e formas deformadas enquanto aderem à rigidez do objeto.

Nossas avaliações abrangentes, abrangendo comparações qualitativas e quantitativas, destacam a superioridade do Draggan sobre os métodos existentes em tarefas relacionadas à manipulação de imagens e rastreamento de pontos. Além disso, demonstramos suas capacidades na manipulação de imagens do mundo real através da inversão de GaN, mostrando seu potencial para várias aplicações práticas no campo da síntese e controle de conteúdo visual.

StabilityAI's Stable Diffusion v2-1 Votos positivos

Drag Your GAN Votos positivos

StabilityAI's Stable Diffusion v2-1 Recursos principais

Síntese de imagens de alta resolução: Gere imagens excelentes usando o modelo avançado de texto para imagem Stable Diffusion v2-1.

Orientado para pesquisa: o modelo tem como alvo aplicações de pesquisa, incluindo a investigação de limitações e preconceitos da IA e implantação segura de conteúdo.

Aplicações artísticas e educacionais: Aproveite a IA para gerar obras de arte ou utilizá-la como ferramenta em processos de design e criativos.

Técnicas de treinamento avançadas: utiliza conjuntos de dados LAION e procedimentos de treinamento inovadores, incluindo atenção cruzada e perda de objetivo v.

Licença de código aberto: Garante a liberdade de usar, modificar e distribuir o modelo com a licença CreativeML Open RAIL++-M.

Drag Your GAN Recursos principais

Nenhum recurso principal listadoStabilityAI's Stable Diffusion v2-1 Categoria

- Image Generation Model

Drag Your GAN Categoria

- Image Generation Model

StabilityAI's Stable Diffusion v2-1 Tipo de tarifação

- Freemium

Drag Your GAN Tipo de tarifação

- Free