OpenChatKit 对比 ggml.ai

探索 OpenChatKit 和 ggml.ai 的对决,找出哪个 AI Large Language Model (LLM) 工具获胜。我们分析赞成票、功能、评论、定价、替代品等等。

在 OpenChatKit 和 ggml.ai 的对决中,哪一个夺冠?

当我们将OpenChatKit与ggml.ai进行对比时,两者都是AI操作的large language model (llm)工具,并将它们并排放置时,我们可以发现几个重要的相似之处和分歧。 OpenChatKit 和 ggml.ai 的点赞数不相上下。 您的投票很重要!通过投票帮助我们决定 aitools.fyi 用户中的获胜者。

您不同意结果?投票帮助我们决定!

OpenChatKit

什么是 OpenChatKit?

Togethercomputer 的 OpenChatKit 是一个尖端的开源工具包,旨在促进专用和通用对话 AI 模型的创建。通过与 Together、LAION 和 Ontocord.ai 的合作,OpenChatKit 充分利用了 OIG-43M 训练数据集的强大功能,为开发人员开发高质量语言模型奠定了坚实的基础。

此 GitHub 存储库充当一个中心,您可以在其中贡献并提取资源,以构建强大的 AI 驱动的聊天应用程序。 OpenChatKit 功能包括指令调整的语言模型,能够理解并遵循特定的用户指令;确保安全和适当互动的调节模型;以及多功能检索系统,允许通过自定义存储库进行实时更新的响应。

ggml.ai

什么是 ggml.ai?

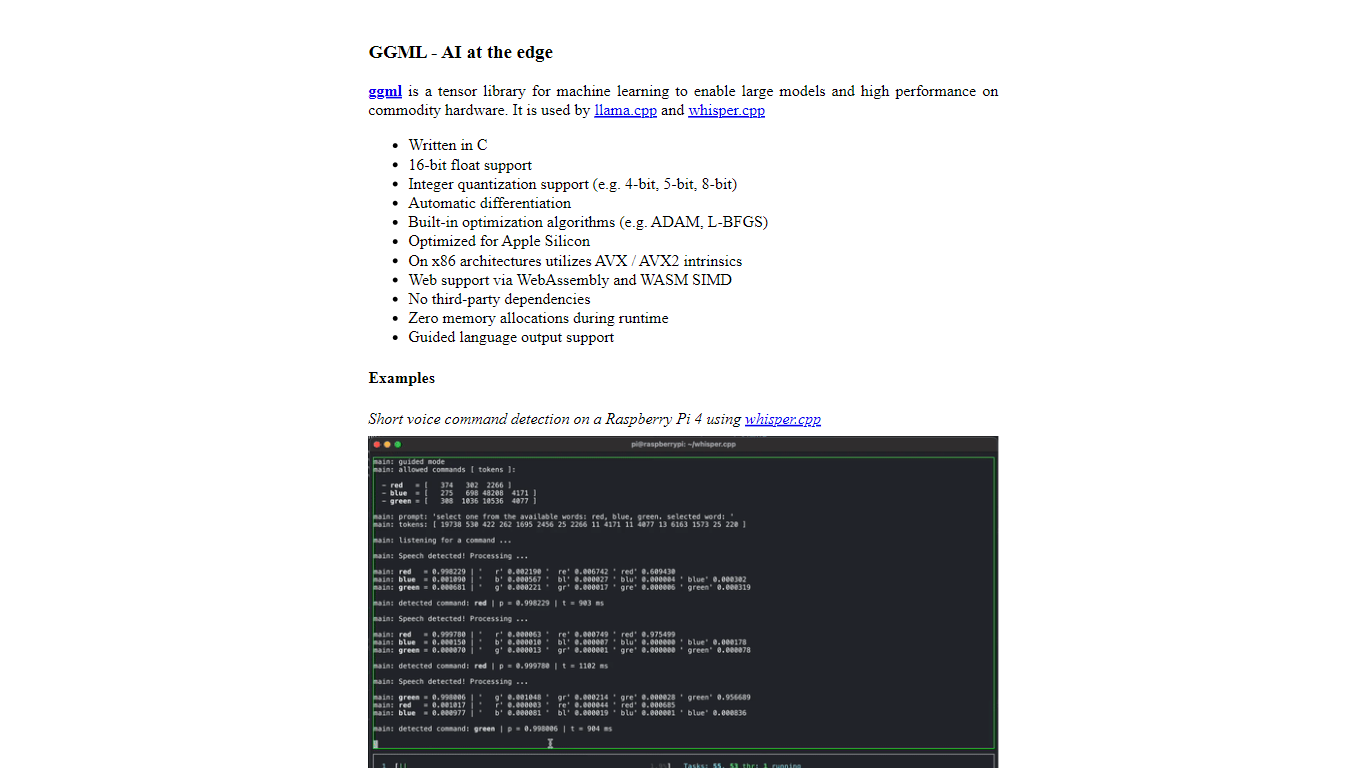

ggml.ai 处于人工智能技术的前沿,通过其创新的张量库将强大的机器学习功能直接带到边缘。 ggml.ai 专为通用硬件平台上的大型模型支持和高性能而构建,使开发人员能够实现先进的人工智能算法,而无需专门的设备。该平台采用高效的 C 编程语言编写,提供 16 位浮点和整数量化支持,以及自动微分和各种内置优化算法(如 ADAM 和 L-BFGS)。它拥有针对 Apple Silicon 的优化性能,并在 x86 架构上利用 AVX/AVX2 内在函数。基于 Web 的应用程序还可以通过 WebAssembly 和 WASM SIMD 支持来利用其功能。凭借零运行时内存分配和不存在第三方依赖项,ggml.ai 为设备上推理提供了一种最小且高效的解决方案。

诸如whisper.cpp和llama.cpp之类的项目展示了ggml.ai的高性能推理能力,其中whisper.cpp提供语音到文本的解决方案,llama.cpp专注于Meta的LLaMA大语言模型的高效推理。此外,该公司欢迎对其代码库做出贡献,并通过 MIT 许可证支持开放核心开发模型。随着 ggml.ai 的不断扩张,它正在寻找对设备上推理有共同愿景的有才华的全职开发人员加入他们的团队。

ggml.ai 旨在突破边缘人工智能的极限,证明了人工智能社区的游戏和创新精神。

OpenChatKit 赞同数

ggml.ai 赞同数

OpenChatKit 顶级功能

指令调整模型: 旨在解释和执行用户提供的特定指令。

审核模型: 确保互动保持适当且符合社区准则。

检索系统: 实施先进的检索系统以获取动态和更新的响应。

开源合作: 受益于与 Together、LAION 和 Ontocord.ai 的合作。

OIG-43M 训练数据集: 利用强大的数据集来优化对话式 AI 模型性能。

ggml.ai 顶级功能

用 C 编写: 确保跨各种平台的高性能和兼容性。

针对 Apple Silicon 的优化: 在 Apple 设备上提供高效的处理和更低的延迟。

支持 WebAssembly 和 WASM SIMD: 促进 Web 应用程序利用机器学习功能。

没有第三方依赖项: 实现整洁的代码库和方便的部署。

引导语言输出支持: 通过更直观的 AI 生成响应来增强人机交互。

OpenChatKit 类别

- Large Language Model (LLM)

ggml.ai 类别

- Large Language Model (LLM)

OpenChatKit 定价类型

- Freemium

ggml.ai 定价类型

- Freemium