DeepSpeed ZeRO++ vs ggml.ai

Compara DeepSpeed ZeRO++ vs ggml.ai y descubre cuál herramienta AI Large Language Model (LLM) es mejor cuando comparamos características, opiniones, precios, alternativas, votos positivos, etc.

¿Cuál es mejor? ¿DeepSpeed ZeRO++ o ggml.ai?

Cuando comparamos DeepSpeed ZeRO++ con ggml.ai, ambas herramientas son impulsadas por inteligencia artificial en la categoría de large language model (llm), Curiosamente, ambas herramientas han logrado asegurar la misma cantidad de votos positivos. Únete a los usuarios de aitools.fyi para decidir al ganador emitiendo tu voto.

¿El resultado te hace pensar "mmm"? ¡Emite tu voto y cambia esa expresión!

DeepSpeed ZeRO++

¿Qué es DeepSpeed ZeRO++?

Microsoft Research ha anunciado el desarrollo de DeepSpeed ZeRO++, una mejora innovadora del modelo ZeRO (Zero Redundancy Optimizer). Este sistema avanzado introduce estrategias de comunicación optimizadas que mejoran drásticamente la eficiencia del entrenamiento de modelos de lenguaje grandes (LLM) y modelos de chat. DeepSpeed ZeRO++ logra esto reduciendo significativamente la cantidad de comunicación necesaria, incluso con lotes de gran tamaño o ancho de banda limitado entre dispositivos. Al reducir los requisitos de comunicación hasta 4 veces, los investigadores y desarrolladores ahora pueden entrenar modelos complejos de manera más rápida y rentable.

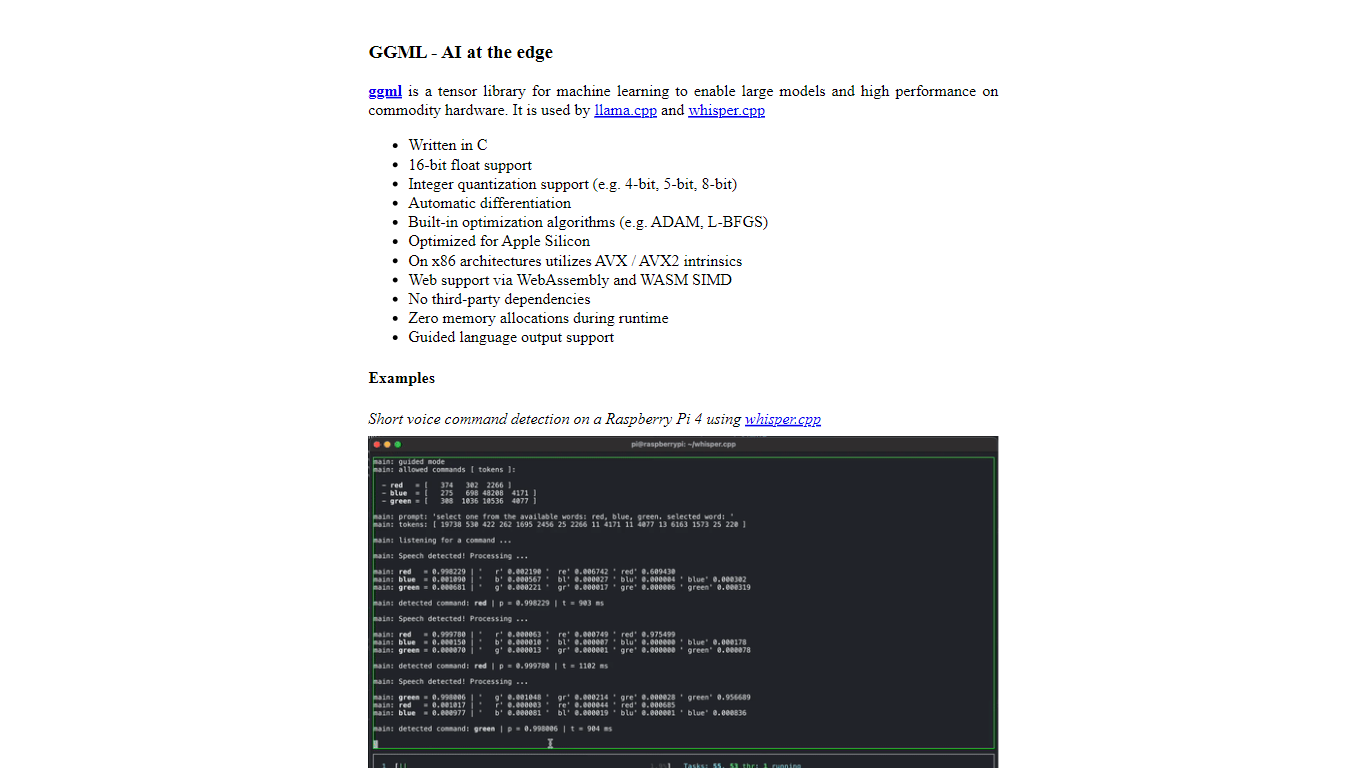

ggml.ai

¿Qué es ggml.ai?

ggml.ai está a la vanguardia de la tecnología de inteligencia artificial y ofrece poderosas capacidades de aprendizaje automático directamente al borde con su innovadora biblioteca de tensores. Creado para admitir modelos grandes y alto rendimiento en plataformas de hardware comunes, ggml.ai permite a los desarrolladores implementar algoritmos de IA avanzados sin la necesidad de equipos especializados. La plataforma, escrita en el eficiente lenguaje de programación C, ofrece soporte de cuantificación de números enteros y flotantes de 16 bits, junto con diferenciación automática y varios algoritmos de optimización integrados como ADAM y L-BFGS. Ofrece un rendimiento optimizado para Apple Silicon y aprovecha los elementos intrínsecos de AVX/AVX2 en arquitecturas x86. Las aplicaciones basadas en web también pueden explotar sus capacidades a través de WebAssembly y la compatibilidad con WASM SIMD. Con sus asignaciones de memoria de tiempo de ejecución cero y la ausencia de dependencias de terceros, ggml.ai presenta una solución mínima y eficiente para la inferencia en el dispositivo.

Proyectos como susurro.cpp y llama.cpp demuestran las capacidades de inferencia de alto rendimiento de ggml.ai, con susurro.cpp proporcionando soluciones de voz a texto y llama.cpp centrándose en la inferencia eficiente del modelo de lenguaje grande LLaMA de Meta. Además, la empresa agradece las contribuciones a su código base y admite un modelo de desarrollo de núcleo abierto a través de la licencia MIT. A medida que ggml.ai continúa expandiéndose, busca desarrolladores talentosos de tiempo completo con una visión compartida de la inferencia en el dispositivo para unirse a su equipo.

Diseñado para llevar la IA al límite, ggml.ai es un testimonio del espíritu de juego e innovación en la comunidad de IA.

DeepSpeed ZeRO++ Votos positivos

ggml.ai Votos positivos

DeepSpeed ZeRO++ Características principales

Característica 1: Optimiza las estrategias de comunicación para LLM y capacitación en modelos de chat.

Característica 2: Logra 4 veces menos comunicación, mejorando la eficiencia de la capacitación.

Característica 3: Adecuado para varios tamaños de lotes y escenarios de ancho de banda.

Característica4: Permite una capacitación de modelos más rápida y rentable.

Característica5: Desarrollado por Microsoft Research, aprovechando la investigación avanzada de IA.

ggml.ai Características principales

Escrito en C: Garantiza un alto rendimiento y compatibilidad en una variedad de plataformas.

Optimización para Apple Silicon: Ofrece procesamiento eficiente y menor latencia en dispositivos Apple.

Compatibilidad con WebAssembly y WASM SIMD: Facilita que las aplicaciones web utilicen capacidades de aprendizaje automático.

Sin dependencias de terceros: Ofrece una base de código ordenada y una implementación conveniente.

Compatibilidad con salida de lenguaje guiado: Mejora la interacción persona-computadora con respuestas más intuitivas generadas por IA.

DeepSpeed ZeRO++ Categoría

- Large Language Model (LLM)

ggml.ai Categoría

- Large Language Model (LLM)

DeepSpeed ZeRO++ Tipo de tarificación

- Freemium

ggml.ai Tipo de tarificación

- Freemium