Distil* vs ggml.ai

En la competencia entre Distil* vs ggml.ai, ¿cuál herramienta AI Large Language Model (LLM) es la campeona? Evaluamos precios, alternativas, votos positivos, características, opiniones, y más.

Si tuvieras que elegir entre Distil* y ggml.ai, ¿cuál elegirías?

Al examinar Distil* y ggml.ai, ambas son herramientas habilitadas por inteligencia artificial en la categoría de large language model (llm), ¿qué características únicas descubrimos? En la carrera por los votos positivos, Distil* se lleva el trofeo. Distil* ha recibido 7 votos positivos de usuarios de aitools.fyi, mientras que ggml.ai ha recibido 6 votos positivos.

¿No estás de acuerdo con el resultado? ¡Emite tu voto y sé parte del proceso de toma de decisiones!

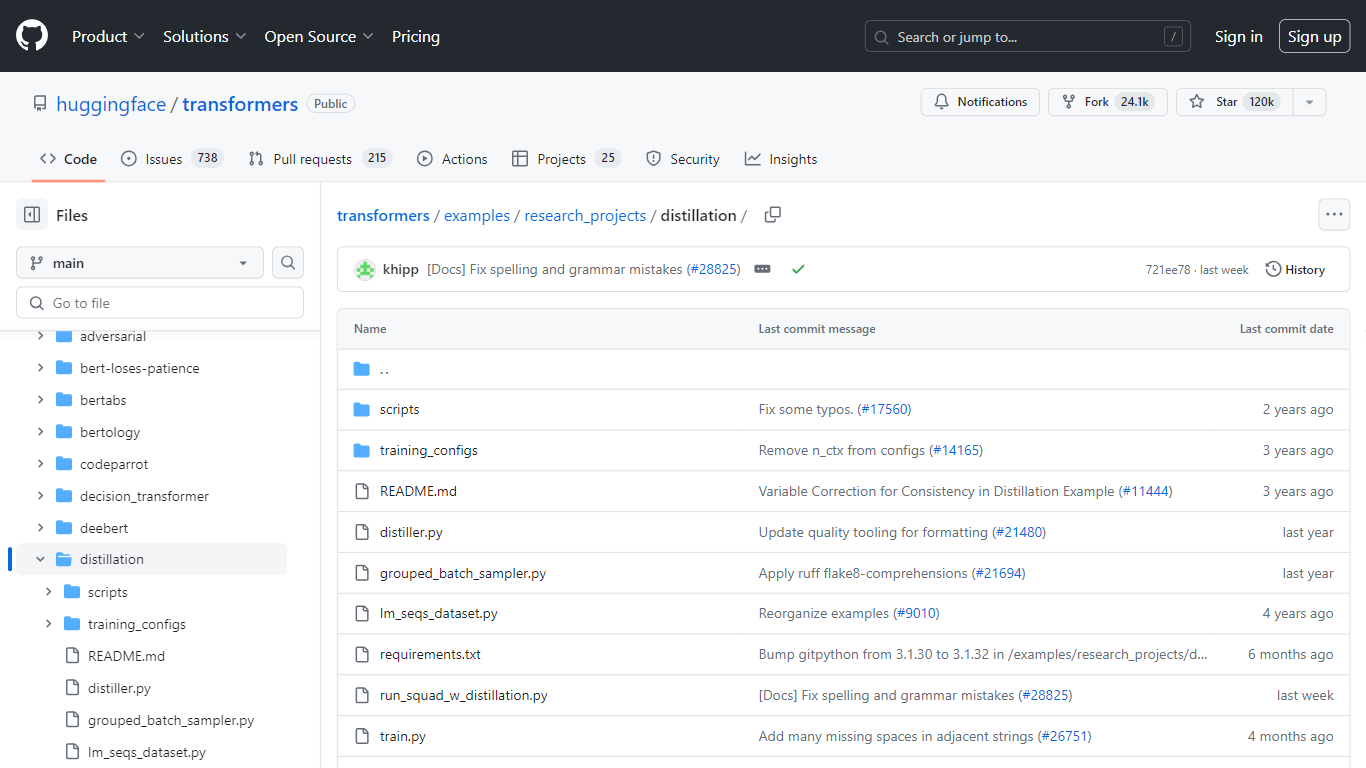

Distil*

¿Qué es Distil*?

Descubra el aprendizaje automático de vanguardia con Hugging Face Transformers, que ofrece modelos de última generación para Pytorch, TensorFlow y JAX. Sumérgete en el proyecto de investigación de 'destilación' en GitHub para explorar cómo las técnicas de destilación de conocimiento pueden comprimir modelos grandes y complejos en contrapartes más pequeñas y más rápidas sin sacrificar significativamente el rendimiento.

Esta parte del repositorio de Hugging Face Transformers contiene ejemplos y scripts que demuestran el entrenamiento y la implementación de modelos destilados como DistilBERT, DistilRoBERTa y DistilGPT2. Aprenda de la documentación detallada y las actualizaciones sobre las mejoras continuas y comprenda cómo se pueden utilizar estos modelos en aplicaciones prácticas para un procesamiento eficiente del lenguaje natural.

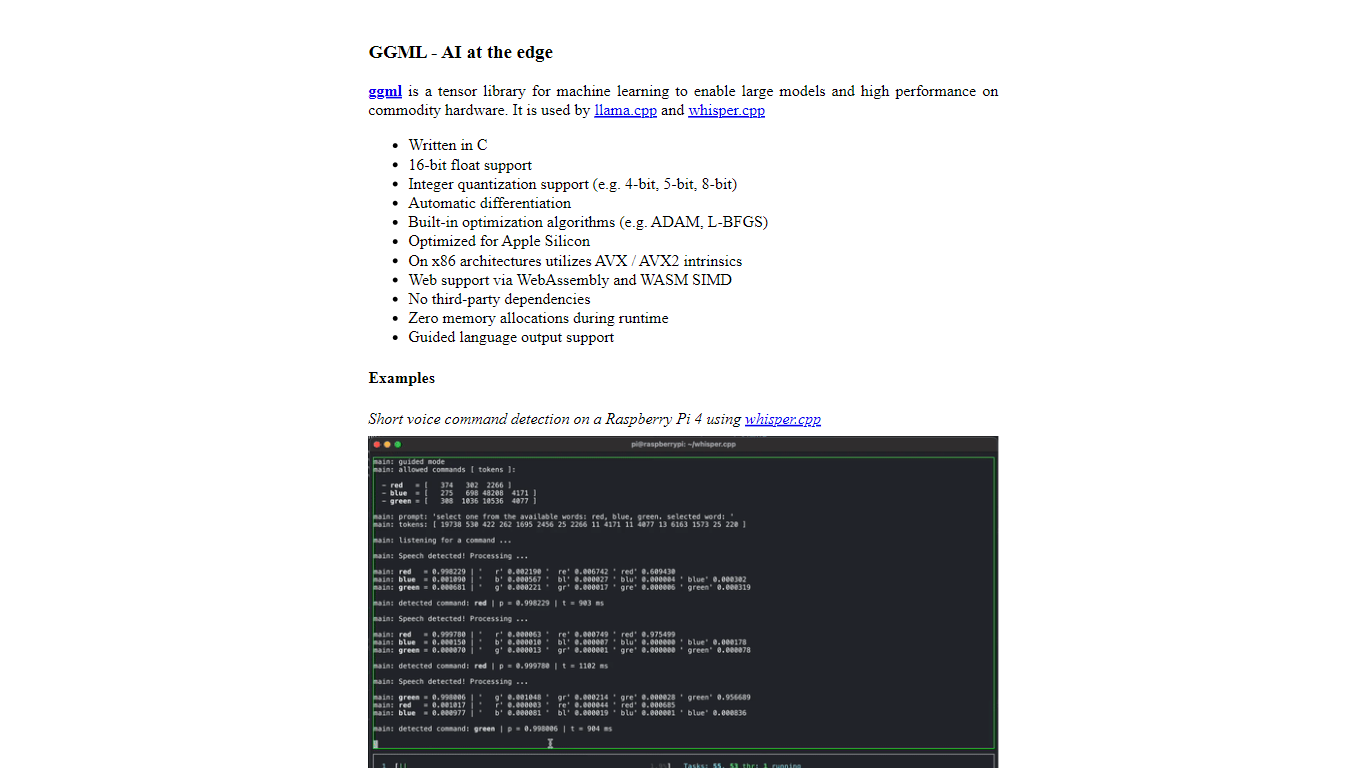

ggml.ai

¿Qué es ggml.ai?

ggml.ai está a la vanguardia de la tecnología de inteligencia artificial y ofrece poderosas capacidades de aprendizaje automático directamente al borde con su innovadora biblioteca de tensores. Creado para admitir modelos grandes y alto rendimiento en plataformas de hardware comunes, ggml.ai permite a los desarrolladores implementar algoritmos de IA avanzados sin la necesidad de equipos especializados. La plataforma, escrita en el eficiente lenguaje de programación C, ofrece soporte de cuantificación de números enteros y flotantes de 16 bits, junto con diferenciación automática y varios algoritmos de optimización integrados como ADAM y L-BFGS. Ofrece un rendimiento optimizado para Apple Silicon y aprovecha los elementos intrínsecos de AVX/AVX2 en arquitecturas x86. Las aplicaciones basadas en web también pueden explotar sus capacidades a través de WebAssembly y la compatibilidad con WASM SIMD. Con sus asignaciones de memoria de tiempo de ejecución cero y la ausencia de dependencias de terceros, ggml.ai presenta una solución mínima y eficiente para la inferencia en el dispositivo.

Proyectos como susurro.cpp y llama.cpp demuestran las capacidades de inferencia de alto rendimiento de ggml.ai, con susurro.cpp proporcionando soluciones de voz a texto y llama.cpp centrándose en la inferencia eficiente del modelo de lenguaje grande LLaMA de Meta. Además, la empresa agradece las contribuciones a su código base y admite un modelo de desarrollo de núcleo abierto a través de la licencia MIT. A medida que ggml.ai continúa expandiéndose, busca desarrolladores talentosos de tiempo completo con una visión compartida de la inferencia en el dispositivo para unirse a su equipo.

Diseñado para llevar la IA al límite, ggml.ai es un testimonio del espíritu de juego e innovación en la comunidad de IA.

Distil* Votos positivos

ggml.ai Votos positivos

Distil* Características principales

Scripts y Configuraciones: Ejemplos y scripts necesarios para entrenar modelos destilados.

Actualizaciones y correcciones de errores: Actualizaciones periódicas y correcciones de errores documentadas para mejorar el rendimiento.

Documentación detallada: Explicaciones detalladas e instrucciones de uso para cada modelo.

Modelos de última generación: Acceso a modelos de alto rendimiento optimizados en cuanto a velocidad y tamaño.

Soporte multilingüe: Modelos como DistilBERT admiten múltiples idiomas, lo que aumenta la versatilidad de las aplicaciones.

ggml.ai Características principales

Escrito en C: Garantiza un alto rendimiento y compatibilidad en una variedad de plataformas.

Optimización para Apple Silicon: Ofrece procesamiento eficiente y menor latencia en dispositivos Apple.

Compatibilidad con WebAssembly y WASM SIMD: Facilita que las aplicaciones web utilicen capacidades de aprendizaje automático.

Sin dependencias de terceros: Ofrece una base de código ordenada y una implementación conveniente.

Compatibilidad con salida de lenguaje guiado: Mejora la interacción persona-computadora con respuestas más intuitivas generadas por IA.

Distil* Categoría

- Large Language Model (LLM)

ggml.ai Categoría

- Large Language Model (LLM)

Distil* Tipo de tarificación

- Free

ggml.ai Tipo de tarificación

- Freemium