Última actualización 10-23-2025

Categoría:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

Distil*

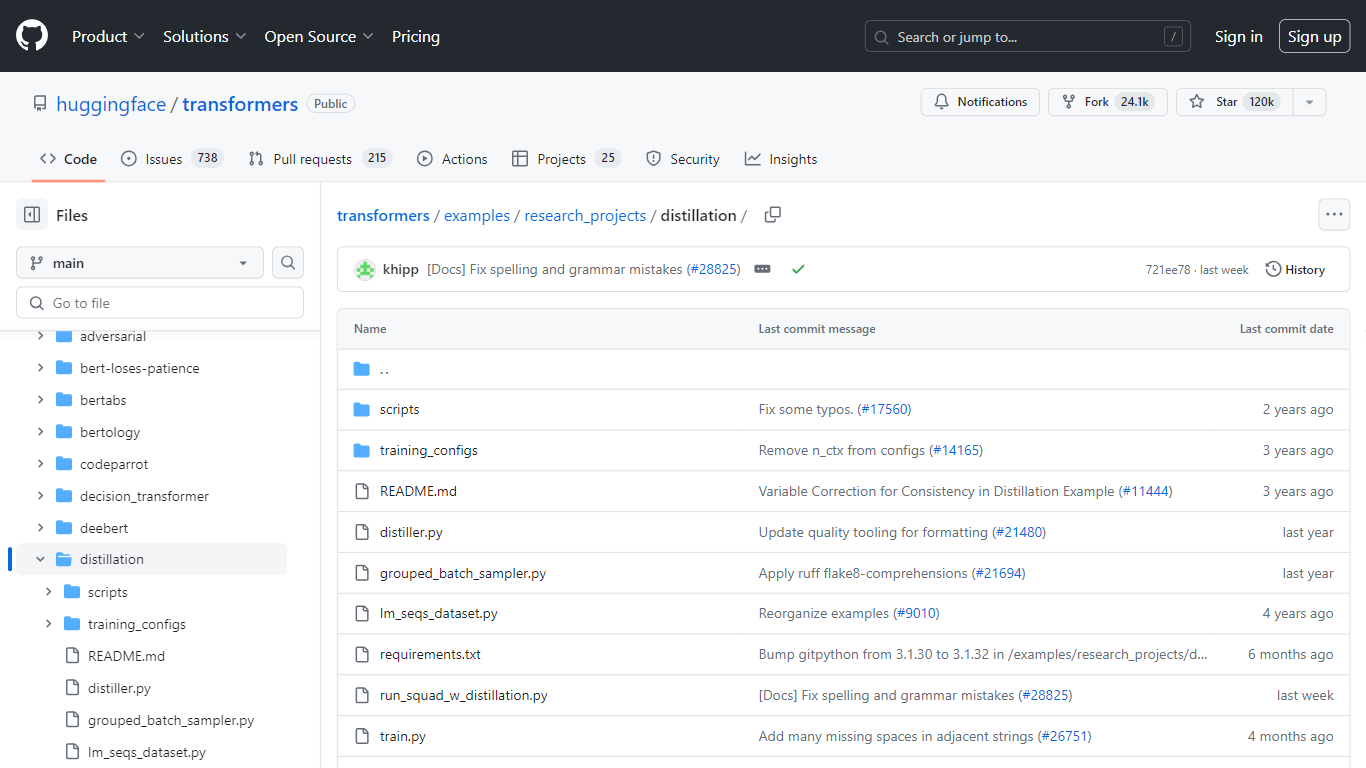

Descubra el aprendizaje automático de vanguardia con Hugging Face Transformers, que ofrece modelos de última generación para Pytorch, TensorFlow y JAX. Sumérgete en el proyecto de investigación de 'destilación' en GitHub para explorar cómo las técnicas de destilación de conocimiento pueden comprimir modelos grandes y complejos en contrapartes más pequeñas y más rápidas sin sacrificar significativamente el rendimiento.

Esta parte del repositorio de Hugging Face Transformers contiene ejemplos y scripts que demuestran el entrenamiento y la implementación de modelos destilados como DistilBERT, DistilRoBERTa y DistilGPT2. Aprenda de la documentación detallada y las actualizaciones sobre las mejoras continuas y comprenda cómo se pueden utilizar estos modelos en aplicaciones prácticas para un procesamiento eficiente del lenguaje natural.

Scripts y Configuraciones: Ejemplos y scripts necesarios para entrenar modelos destilados.

Actualizaciones y correcciones de errores: Actualizaciones periódicas y correcciones de errores documentadas para mejorar el rendimiento.

Documentación detallada: Explicaciones detalladas e instrucciones de uso para cada modelo.

Modelos de última generación: Acceso a modelos de alto rendimiento optimizados en cuanto a velocidad y tamaño.

Soporte multilingüe: Modelos como DistilBERT admiten múltiples idiomas, lo que aumenta la versatilidad de las aplicaciones.

¿Qué es Distil* en el contexto de Hugging Face Transformers?

Distil* se refiere a una clase de modelos comprimidos que son versiones más pequeñas, más rápidas y más livianas de sus contrapartes originales, conservando gran parte de su rendimiento y al mismo tiempo son más eficientes.

¿Qué es la destilación del conocimiento?

La destilación de conocimientos es un método en el que un modelo más pequeño (estudiante) aprende a realizar una tarea con la misma eficacia que un modelo más grande (maestro) entrenándose en los resultados del modelo más grande.

¿Dónde se pueden encontrar ejemplos de destilación para DistilBERT, DistilRoBERTa y DistilGPT2?

Los ejemplos de destilación se pueden encontrar en la carpeta 'distillation' del repositorio oficial de GitHub de Transformers.

¿Con qué frecuencia se actualizan y mantienen los modelos destilados?

El progreso y las actualizaciones se comparten periódicamente junto con la resolución de cualquier error identificado, como se muestra en los registros de actualización del repositorio.

¿Cuántos idiomas admite DistilBERT?

DistilBERT admite 104 idiomas diferentes, según se enumeran en el repositorio proporcionado, y ofrece una amplia gama de aplicaciones para tareas multilingües.