FLAN-T5 vs ggml.ai

Sumérgete en la comparación de FLAN-T5 vs ggml.ai y descubre cuál herramienta AI Large Language Model (LLM) se destaca. Analizamos alternativas, votos positivos, características, opiniones, precios, y más.

Al comparar FLAN-T5 y ggml.ai, ¿cuál se destaca por encima del otro?

Al comparar FLAN-T5 y ggml.ai, dos herramientas excepcionales de la categoría de large language model (llm) impulsadas por inteligencia artificial, y colocarlas lado a lado, se destacan varias similitudes y diferencias clave. No hay un claro ganador en términos de votos positivos, ya que ambas herramientas han recibido la misma cantidad. Sé parte del proceso de toma de decisiones. Tu voto podría determinar al ganador.

¿No estás de acuerdo con el resultado? ¡Emite tu voto y sé parte del proceso de toma de decisiones!

FLAN-T5

¿Qué es FLAN-T5?

FLAN-T5 es un modelo de lenguaje avanzado desarrollado por Google y presentado en el artículo "Scaling Institution-Finetuned Language Models". Representa una actualización con respecto al T5 (Transformador de transferencia de texto a texto) original al ajustarse en una amplia gama de tareas. El modelo ofrece simplicidad y flexibilidad en la comprensión y generación del lenguaje natural, lo que permite a los usuarios utilizar sus capacidades sin necesidad de ajustes adicionales. FLAN-T5 está disponible en varios tamaños para satisfacer diferentes necesidades y recursos informáticos, incluidas las variantes pequeña, básica, grande, XL y XXL.

El uso de este modelo es sencillo a través de la biblioteca Hugging Face Transformers, que proporciona una rica colección de herramientas para aplicaciones de IA. Ya sea para generar texto, resumir contenido o traducir idiomas, FLAN-T5 está diseñado para manejar una gran variedad de tareas con mayor eficiencia y precisión. Además, este modelo defiende la misión de democratizar la IA al ser de código abierto, garantizar la accesibilidad y la colaboración comunitaria.

ggml.ai

¿Qué es ggml.ai?

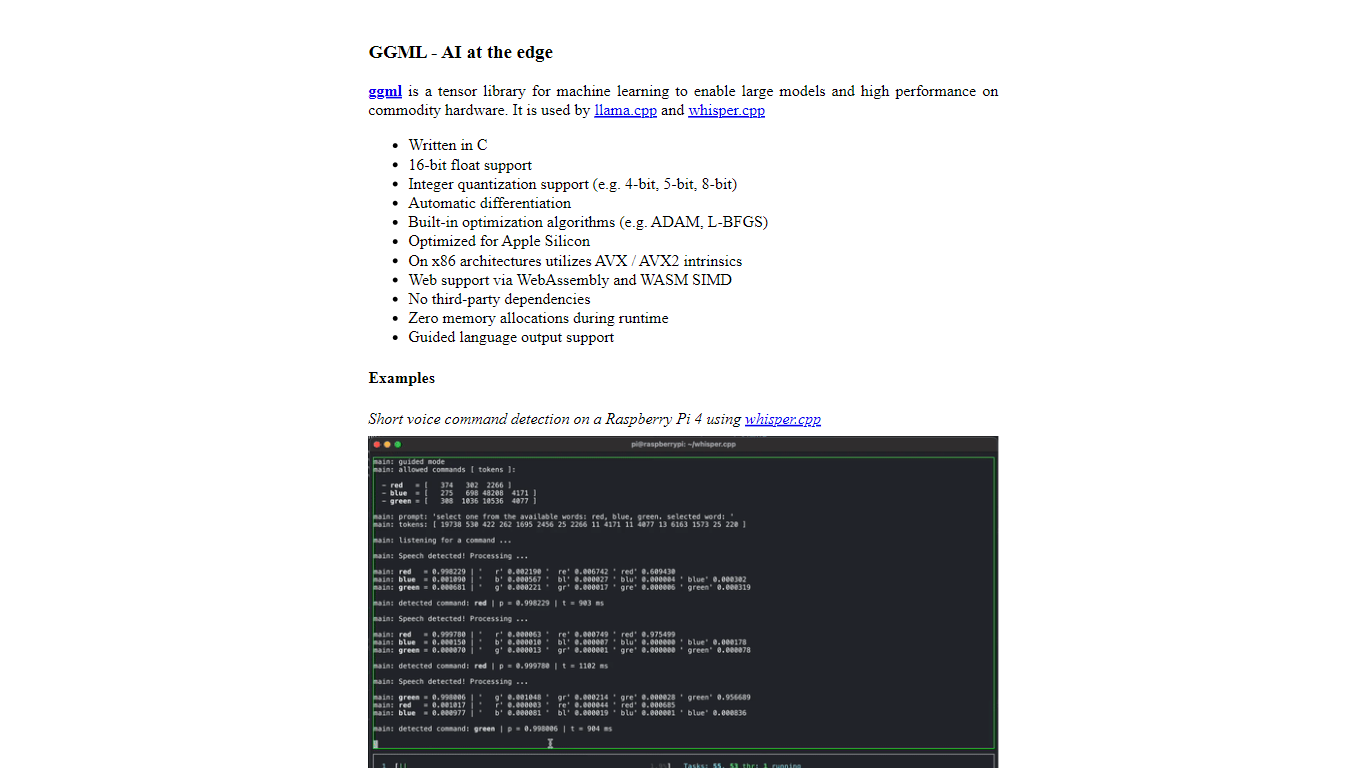

ggml.ai está a la vanguardia de la tecnología de inteligencia artificial y ofrece poderosas capacidades de aprendizaje automático directamente al borde con su innovadora biblioteca de tensores. Creado para admitir modelos grandes y alto rendimiento en plataformas de hardware comunes, ggml.ai permite a los desarrolladores implementar algoritmos de IA avanzados sin la necesidad de equipos especializados. La plataforma, escrita en el eficiente lenguaje de programación C, ofrece soporte de cuantificación de números enteros y flotantes de 16 bits, junto con diferenciación automática y varios algoritmos de optimización integrados como ADAM y L-BFGS. Ofrece un rendimiento optimizado para Apple Silicon y aprovecha los elementos intrínsecos de AVX/AVX2 en arquitecturas x86. Las aplicaciones basadas en web también pueden explotar sus capacidades a través de WebAssembly y la compatibilidad con WASM SIMD. Con sus asignaciones de memoria de tiempo de ejecución cero y la ausencia de dependencias de terceros, ggml.ai presenta una solución mínima y eficiente para la inferencia en el dispositivo.

Proyectos como susurro.cpp y llama.cpp demuestran las capacidades de inferencia de alto rendimiento de ggml.ai, con susurro.cpp proporcionando soluciones de voz a texto y llama.cpp centrándose en la inferencia eficiente del modelo de lenguaje grande LLaMA de Meta. Además, la empresa agradece las contribuciones a su código base y admite un modelo de desarrollo de núcleo abierto a través de la licencia MIT. A medida que ggml.ai continúa expandiéndose, busca desarrolladores talentosos de tiempo completo con una visión compartida de la inferencia en el dispositivo para unirse a su equipo.

Diseñado para llevar la IA al límite, ggml.ai es un testimonio del espíritu de juego e innovación en la comunidad de IA.

FLAN-T5 Votos positivos

ggml.ai Votos positivos

FLAN-T5 Características principales

Uso directo sin ajustes: FLAN-T5 se puede utilizar directamente sin necesidad de ajustes adicionales por parte de los usuarios.

Variedad de tamaños: El modelo está disponible en varios tamaños, incluidos pequeño, básico, grande, XL y XXL.

Versión mejorada de T5: FLAN-T5 incluye todas las mejoras de T5 versión 1.1.

Accesible a través de Hugging Face Transformers: Se puede acceder a FLAN-T5 a través de la biblioteca Hugging Face Transformers para facilitar su uso en diversas aplicaciones.

Código abierto: El modelo se alinea con las prácticas científicas abiertas y encarna el principio de democratizar la inteligencia artificial.

ggml.ai Características principales

Escrito en C: Garantiza un alto rendimiento y compatibilidad en una variedad de plataformas.

Optimización para Apple Silicon: Ofrece procesamiento eficiente y menor latencia en dispositivos Apple.

Compatibilidad con WebAssembly y WASM SIMD: Facilita que las aplicaciones web utilicen capacidades de aprendizaje automático.

Sin dependencias de terceros: Ofrece una base de código ordenada y una implementación conveniente.

Compatibilidad con salida de lenguaje guiado: Mejora la interacción persona-computadora con respuestas más intuitivas generadas por IA.

FLAN-T5 Categoría

- Large Language Model (LLM)

ggml.ai Categoría

- Large Language Model (LLM)

FLAN-T5 Tipo de tarificación

- Freemium

ggml.ai Tipo de tarificación

- Freemium