GLaM vs ggml.ai

En la confrontación entre GLaM vs ggml.ai, ¿cuál herramienta AI Large Language Model (LLM) sale victoriosa? Evaluamos opiniones, precios, alternativas, características, votos positivos, y más.

Cuando ponemos a GLaM y ggml.ai cara a cara, ¿cuál emerge como el vencedor?

Echemos un vistazo más de cerca a GLaM y ggml.ai, ambas son herramientas impulsadas por inteligencia artificial en la categoría de large language model (llm), y veamos qué las distingue. El conteo de votos positivos está muy parejo para tanto GLaM como ggml.ai. ¡Cada voto cuenta! Emite el tuyo y contribuye a la decisión del ganador.

¿No es lo tuyo? ¡Vota por tu herramienta preferida y agita las cosas!

GLaM

¿Qué es GLaM?

El artículo titulado "GLaM: Escalamiento eficiente de modelos lingüísticos con una combinación de expertos" presenta un enfoque novedoso para el desarrollo de modelos lingüísticos que mejora la eficiencia y el rendimiento. Los modelos densos tradicionales como GPT-3 han logrado avances en el procesamiento del lenguaje natural (NLP) mediante la ampliación con grandes conjuntos de datos y una mayor potencia computacional. Sin embargo, esta ampliación tiene un alto coste en términos de recursos.

El modelo GLaM propuesto aborda este problema introduciendo una arquitectura de mezcla de expertos escasamente activada. Esto permite que GLaM tenga una cantidad significativamente mayor de parámetros (1,2 billones, que es aproximadamente 7 veces mayor que la de GPT-3) al tiempo que reduce tanto los requisitos de energía como los cálculos necesarios para el entrenamiento y la inferencia. Sorprendentemente, GLaM también supera a GPT-3 en aprendizaje de una sola vez y cero en 29 tareas de PNL, lo que marca un paso adelante en la búsqueda de modelos de lenguaje más eficientes y potentes.

ggml.ai

¿Qué es ggml.ai?

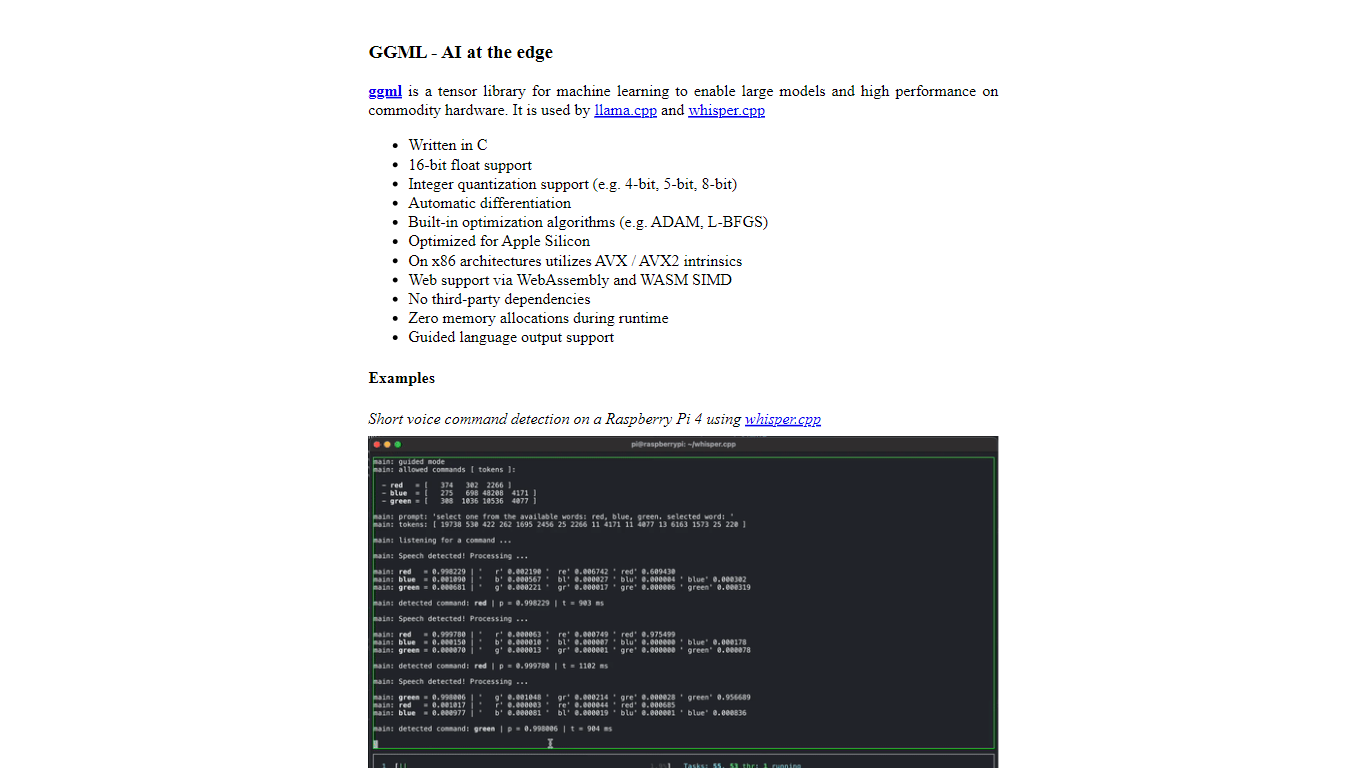

ggml.ai está a la vanguardia de la tecnología de inteligencia artificial y ofrece poderosas capacidades de aprendizaje automático directamente al borde con su innovadora biblioteca de tensores. Creado para admitir modelos grandes y alto rendimiento en plataformas de hardware comunes, ggml.ai permite a los desarrolladores implementar algoritmos de IA avanzados sin la necesidad de equipos especializados. La plataforma, escrita en el eficiente lenguaje de programación C, ofrece soporte de cuantificación de números enteros y flotantes de 16 bits, junto con diferenciación automática y varios algoritmos de optimización integrados como ADAM y L-BFGS. Ofrece un rendimiento optimizado para Apple Silicon y aprovecha los elementos intrínsecos de AVX/AVX2 en arquitecturas x86. Las aplicaciones basadas en web también pueden explotar sus capacidades a través de WebAssembly y la compatibilidad con WASM SIMD. Con sus asignaciones de memoria de tiempo de ejecución cero y la ausencia de dependencias de terceros, ggml.ai presenta una solución mínima y eficiente para la inferencia en el dispositivo.

Proyectos como susurro.cpp y llama.cpp demuestran las capacidades de inferencia de alto rendimiento de ggml.ai, con susurro.cpp proporcionando soluciones de voz a texto y llama.cpp centrándose en la inferencia eficiente del modelo de lenguaje grande LLaMA de Meta. Además, la empresa agradece las contribuciones a su código base y admite un modelo de desarrollo de núcleo abierto a través de la licencia MIT. A medida que ggml.ai continúa expandiéndose, busca desarrolladores talentosos de tiempo completo con una visión compartida de la inferencia en el dispositivo para unirse a su equipo.

Diseñado para llevar la IA al límite, ggml.ai es un testimonio del espíritu de juego e innovación en la comunidad de IA.

GLaM Votos positivos

ggml.ai Votos positivos

GLaM Características principales

Gran capacidad de modelo: El modelo GLaM tiene 1,2 billones de parámetros.

Eficiencia mejorada: El entrenamiento GLaM consume solo un tercio de la energía en comparación con GPT-3.

Requisitos computacionales reducidos: GLaM requiere la mitad de los fallos de cálculo para la inferencia.

Rendimiento excepcional: GLaM logra un mejor rendimiento general en tareas de aprendizaje de una sola vez y cero.

Arquitectura innovadora: GLaM utiliza un marco de combinación de expertos escasamente activado.

ggml.ai Características principales

Escrito en C: Garantiza un alto rendimiento y compatibilidad en una variedad de plataformas.

Optimización para Apple Silicon: Ofrece procesamiento eficiente y menor latencia en dispositivos Apple.

Compatibilidad con WebAssembly y WASM SIMD: Facilita que las aplicaciones web utilicen capacidades de aprendizaje automático.

Sin dependencias de terceros: Ofrece una base de código ordenada y una implementación conveniente.

Compatibilidad con salida de lenguaje guiado: Mejora la interacción persona-computadora con respuestas más intuitivas generadas por IA.

GLaM Categoría

- Large Language Model (LLM)

ggml.ai Categoría

- Large Language Model (LLM)

GLaM Tipo de tarificación

- Free

ggml.ai Tipo de tarificación

- Freemium