Ollama vs ggml.ai

En el enfrentamiento entre Ollama vs ggml.ai, ¿cuál herramienta AI Large Language Model (LLM) se lleva la corona? Escrutamos características, alternativas, votos positivos, opiniones, precios, y más.

En un enfrentamiento entre Ollama y ggml.ai, ¿cuál se lleva la corona?

Si analizáramos Ollama y ggml.ai, ambas herramientas son impulsadas por inteligencia artificial en la categoría de large language model (llm), ¿qué encontraríamos? Ambas herramientas han recibido la misma cantidad de votos positivos de usuarios de aitools.fyi. ¡Tu voto importa! Ayúdanos a decidir al ganador entre los usuarios de aitools.fyi emitiendo tu voto.

¿No estás de acuerdo con el resultado? ¡Emite tu voto y sé parte del proceso de toma de decisiones!

Ollama

¿Qué es Ollama?

Ollama se encuentra a la vanguardia de la innovación en la industria de la inteligencia artificial con un enfoque particular en grandes modelos de lenguaje. Los usuarios que buscan aprovechar el poder de estas herramientas avanzadas no necesitan buscar más, ya que Ollama proporciona una plataforma accesible para ejecutar una variedad de modelos de lenguaje de gran tamaño, incluidos Llama 3, Phi 3, Mistral y Gemma.

Esta plataforma no se trata sólo de ejecutar modelos existentes; también permite a los usuarios personalizar y crear los suyos propios, ofreciendo un nivel de personalización que se adapta a una variedad de casos de uso y mejora sus capacidades de aprendizaje automático.

Compatible con los principales sistemas operativos como macOS, Linux y Windows (actualmente en versión preliminar), Ollama garantiza que una amplia audiencia pueda utilizar estas herramientas sin la barrera de las limitaciones de la plataforma. Este compromiso con la accesibilidad se demuestra aún más a través de sus canales de soporte al usuario, incluidos un Blog, Discord y GitHub, que brindan un enfoque centrado en la comunidad para compartir conocimientos, actualizaciones y soporte técnico. Al descargar el software de Ollama, los usuarios están equipados para interactuar con una tecnología que está dando forma al futuro de las tareas asistidas por IA.

ggml.ai

¿Qué es ggml.ai?

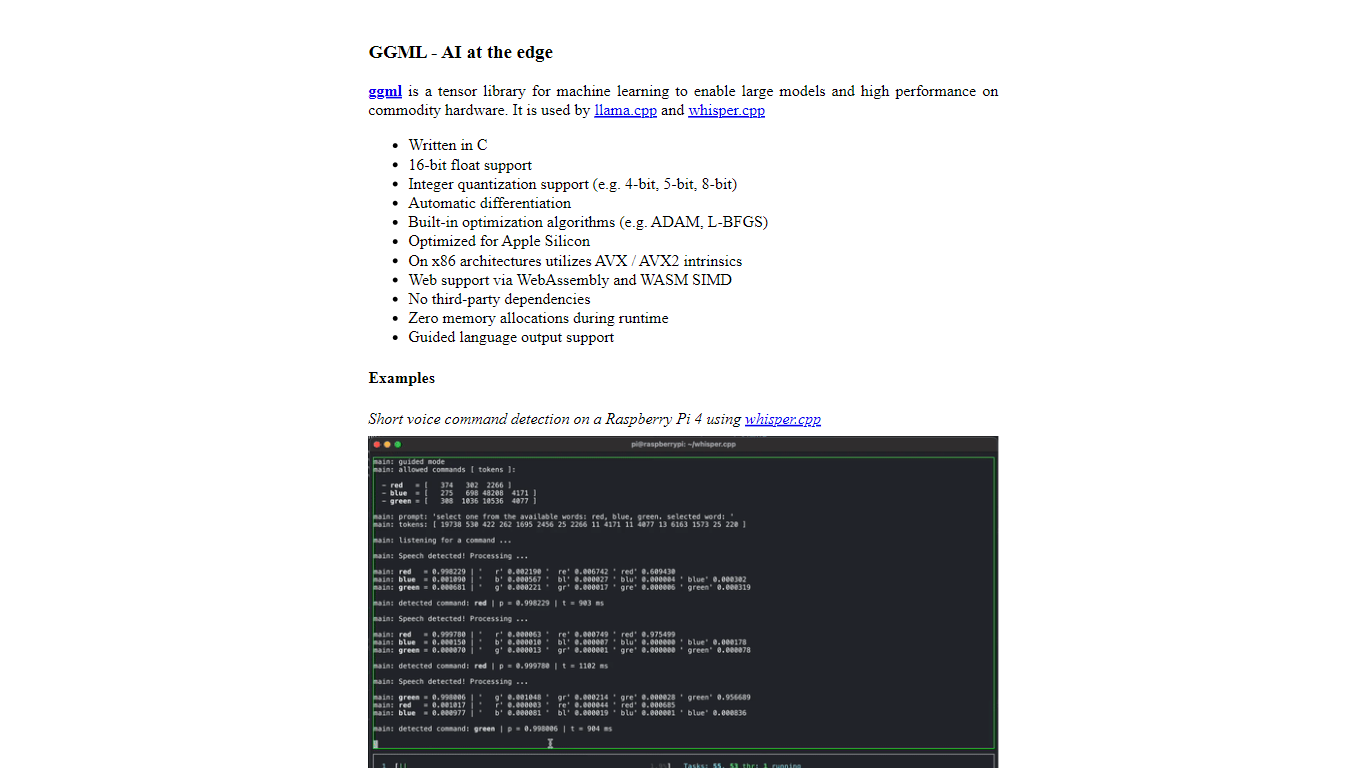

ggml.ai está a la vanguardia de la tecnología de inteligencia artificial y ofrece poderosas capacidades de aprendizaje automático directamente al borde con su innovadora biblioteca de tensores. Creado para admitir modelos grandes y alto rendimiento en plataformas de hardware comunes, ggml.ai permite a los desarrolladores implementar algoritmos de IA avanzados sin la necesidad de equipos especializados. La plataforma, escrita en el eficiente lenguaje de programación C, ofrece soporte de cuantificación de números enteros y flotantes de 16 bits, junto con diferenciación automática y varios algoritmos de optimización integrados como ADAM y L-BFGS. Ofrece un rendimiento optimizado para Apple Silicon y aprovecha los elementos intrínsecos de AVX/AVX2 en arquitecturas x86. Las aplicaciones basadas en web también pueden explotar sus capacidades a través de WebAssembly y la compatibilidad con WASM SIMD. Con sus asignaciones de memoria de tiempo de ejecución cero y la ausencia de dependencias de terceros, ggml.ai presenta una solución mínima y eficiente para la inferencia en el dispositivo.

Proyectos como susurro.cpp y llama.cpp demuestran las capacidades de inferencia de alto rendimiento de ggml.ai, con susurro.cpp proporcionando soluciones de voz a texto y llama.cpp centrándose en la inferencia eficiente del modelo de lenguaje grande LLaMA de Meta. Además, la empresa agradece las contribuciones a su código base y admite un modelo de desarrollo de núcleo abierto a través de la licencia MIT. A medida que ggml.ai continúa expandiéndose, busca desarrolladores talentosos de tiempo completo con una visión compartida de la inferencia en el dispositivo para unirse a su equipo.

Diseñado para llevar la IA al límite, ggml.ai es un testimonio del espíritu de juego e innovación en la comunidad de IA.

Ollama Votos positivos

ggml.ai Votos positivos

Ollama Características principales

Ejecute varios modelos: Acceda y ejecute un conjunto de modelos de lenguaje de gran tamaño, incluidos Llama 3, Phi 3, Mistral y Gemma.

Capacidad de personalización: Adapte y cree sus propios modelos para satisfacer necesidades y preferencias específicas.

Disponibilidad multiplataforma: Descargue y ejecute Ollama en macOS, Linux y Windows (versión preliminar).

Participación de la comunidad: Únase a la discusión y obtenga soporte a través de canales comunitarios como Blog, Discord y GitHub.

Instalación fácil de usar: Proceso de instalación simple para comenzar a utilizar modelos de IA.

ggml.ai Características principales

Escrito en C: Garantiza un alto rendimiento y compatibilidad en una variedad de plataformas.

Optimización para Apple Silicon: Ofrece procesamiento eficiente y menor latencia en dispositivos Apple.

Compatibilidad con WebAssembly y WASM SIMD: Facilita que las aplicaciones web utilicen capacidades de aprendizaje automático.

Sin dependencias de terceros: Ofrece una base de código ordenada y una implementación conveniente.

Compatibilidad con salida de lenguaje guiado: Mejora la interacción persona-computadora con respuestas más intuitivas generadas por IA.

Ollama Categoría

- Large Language Model (LLM)

ggml.ai Categoría

- Large Language Model (LLM)

Ollama Tipo de tarificación

- Freemium

ggml.ai Tipo de tarificación

- Freemium