RWKV-LM vs Terracotta

Sumérgete en la comparación de RWKV-LM vs Terracotta y descubre cuál herramienta AI Large Language Model (LLM) se destaca. Analizamos alternativas, votos positivos, características, opiniones, precios, y más.

Al comparar RWKV-LM y Terracotta, ¿cuál se destaca por encima del otro?

Al comparar RWKV-LM y Terracotta, dos herramientas excepcionales de la categoría de large language model (llm) impulsadas por inteligencia artificial, y colocarlas lado a lado, se destacan varias similitudes y diferencias clave. No hay un claro ganador en términos de votos positivos, ya que ambas herramientas han recibido la misma cantidad. Sé parte del proceso de toma de decisiones. Tu voto podría determinar al ganador.

¿Te sientes rebelde? ¡Emite tu voto y sacude las cosas!

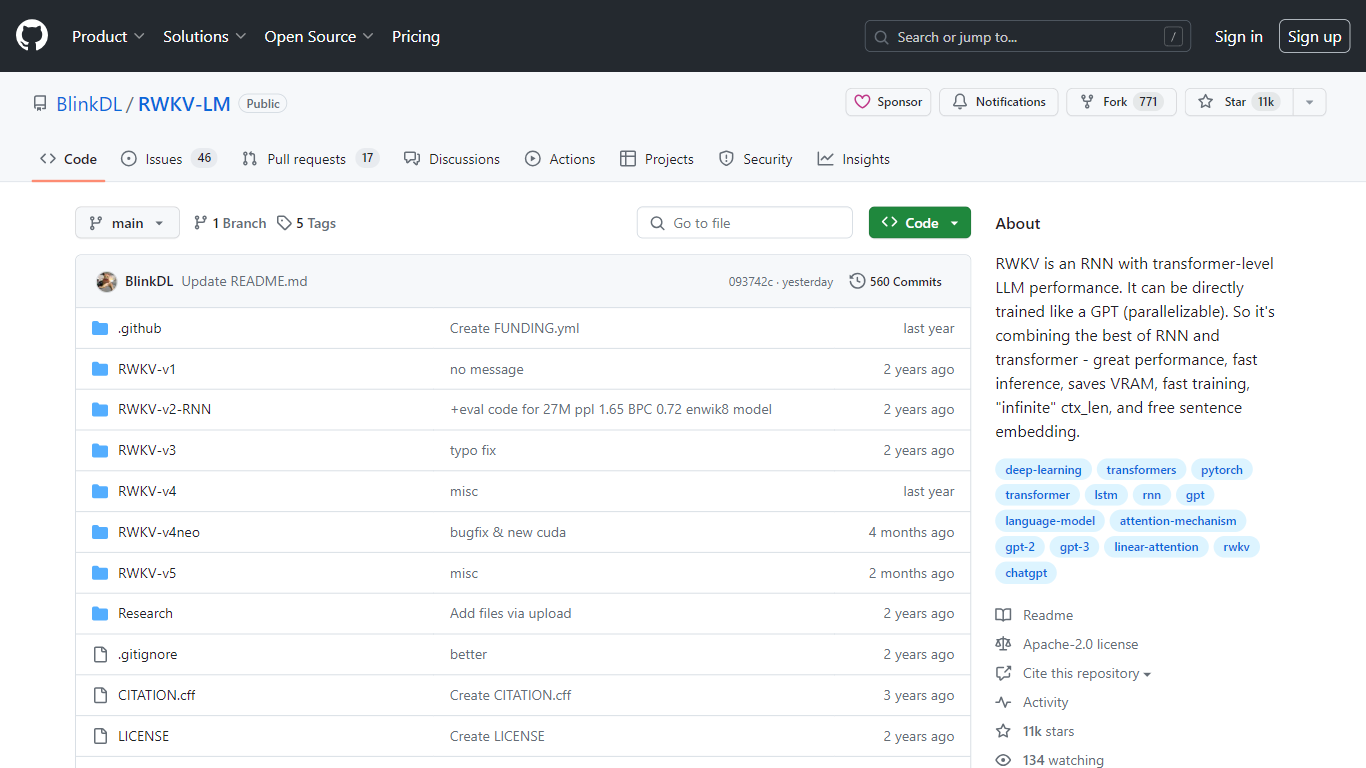

RWKV-LM

¿Qué es RWKV-LM?

RWKV es un innovador modelo de lenguaje basado en RNN que ofrece el rendimiento excepcional de los modelos de lenguaje grande (LLM) a nivel de transformador. Esta notable fusión de la simplicidad de RNN con la eficiencia del transformador crea un modelo altamente paralelizable, similar a los modelos GPT. RWKV no solo es rápido en inferencias, sino que también demuestra velocidades de entrenamiento convenientes y al mismo tiempo es eficiente en memoria, conservando así la valiosa VRAM.

Admite una longitud de contexto "infinita", lo que le permite manejar secuencias de datos muy largas sin problemas. Además, los usuarios se benefician de capacidades gratuitas de incrustación de oraciones, lo que mejora su utilidad para una amplia gama de aplicaciones de procesamiento de lenguaje natural. Como proyecto con licencia Apache-2.0, se presenta como un repositorio público en GitHub, lo que invita a la colaboración y el desarrollo continuo.

Terracotta

¿Qué es Terracotta?

Terracotta es una plataforma de vanguardia diseñada para mejorar el flujo de trabajo de desarrolladores e investigadores que trabajan con modelos de lenguajes grandes (LLM). Esta plataforma intuitiva y fácil de usar le permite administrar, iterar y evaluar sus modelos ajustados con facilidad. Con Terracotta, puede cargar datos de forma segura, ajustar modelos para diversas tareas como clasificación y generación de texto, y crear evaluaciones integrales para comparar el rendimiento del modelo utilizando métricas tanto cualitativas como cuantitativas. Nuestra herramienta admite conexiones con proveedores importantes como OpenAI y Cohere, lo que garantiza que tenga acceso a una amplia gama de capacidades de LLM. Terracotta es la creación de Beri Kohen y Lucas Pauker, entusiastas de la IA y graduados de Stanford, que se dedican a promover el desarrollo de LLM. Únase a nuestra lista de correo electrónico para mantenerse informado sobre las últimas actualizaciones y características que Terracotta tiene para ofrecer.

RWKV-LM Votos positivos

Terracotta Votos positivos

RWKV-LM Características principales

Gran rendimiento: Ofrece rendimiento LLM a nivel de transformador en una arquitectura RNN más compacta.

Inferencia rápida: Diseñado para respuestas rápidas, lo que lo hace adecuado para aplicaciones en tiempo real.

Ahorro de VRAM: Optimizado para utilizar menos VRAM sin comprometer la eficiencia.

Entrenamiento rápido: Capaz de entrenarse rápidamente, lo que reduce el tiempo necesario para desarrollar modelos robustos.

Longitud de contexto infinita: Se adapta a secuencias extremadamente largas y ofrece flexibilidad para procesar grandes cantidades de datos.

Terracotta Características principales

Administre muchos modelos: Maneje centralmente todos sus modelos ajustados en un lugar conveniente.

Itere rápidamente: Optimice el proceso de mejora del modelo con evaluaciones cualitativas y cuantitativas rápidas.

Múltiples proveedores: Integre perfectamente con los servicios de OpenAI y Cohere para potenciar su proceso de desarrollo.

Cargue sus datos: Cargue y almacene de forma segura sus conjuntos de datos para ajustar los modelos.

Crear evaluaciones: Realice evaluaciones comparativas en profundidad del rendimiento del modelo aprovechando métricas como la precisión BLEU y las matrices de confusión.

RWKV-LM Categoría

- Large Language Model (LLM)

Terracotta Categoría

- Large Language Model (LLM)

RWKV-LM Tipo de tarificación

- Free

Terracotta Tipo de tarificación

- Freemium