Última actualización 10-23-2025

Categoría:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

Drag Your GAN

En el ámbito de la sintetización de contenido visual para satisfacer las necesidades de los usuarios, es esencial lograr un control preciso sobre la pose, la forma, la expresión y el diseño de los objetos generados. Los enfoques tradicionales para controlar las redes adversas generativas (GAN) se han basado en anotaciones manuales durante la capacitación o modelos 3D anteriores, a menudo carecen de la flexibilidad, la precisión y la versatilidad requeridas para diversas aplicaciones.

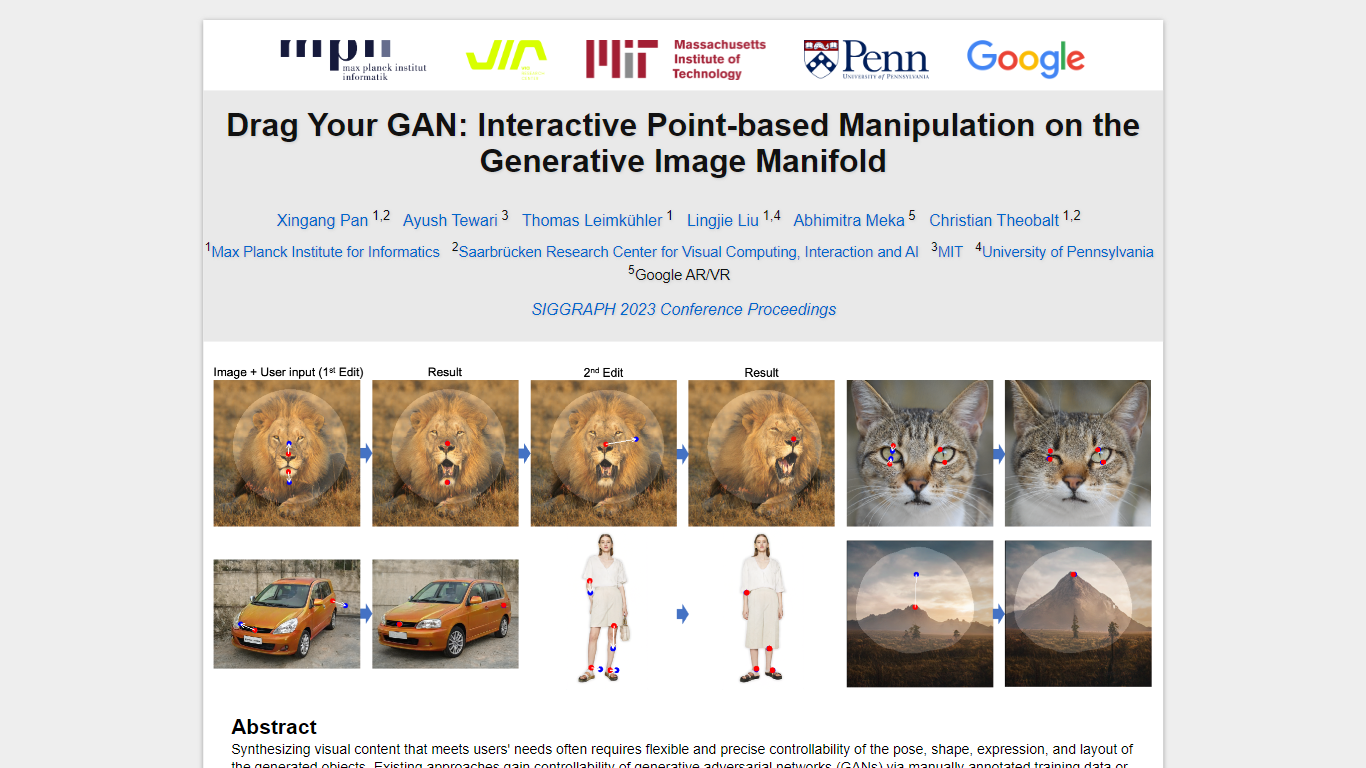

En nuestra investigación, exploramos un método innovador y relativamente desconocido para el control de GaN, la capacidad de "arrastrar" puntos de imagen específicos para alcanzar con precisión los puntos objetivo definidos por el usuario de manera interactiva (como se ilustra en la Fig.1). Este enfoque ha llevado al desarrollo de Draggan, un marco novedoso que comprende dos componentes centrales:

Supervisión de movimiento basada en características: este componente guía los puntos de manejo dentro de la imagen hacia sus posiciones objetivo previstas a través de la supervisión de movimiento basada en características.

Seguimiento de puntos: aprovechando las características discriminativas de GaN, nuestra nueva técnica de seguimiento de puntos localiza continuamente la posición de los puntos de manejo.

Draggan faculta a los usuarios para deformar las imágenes con notable precisión, permitiendo la manipulación de la pose, la forma, la expresión y el diseño en diversas categorías, como animales, automóviles, humanos, paisajes y más. Estas manipulaciones tienen lugar dentro del colector de imágenes generativas aprendidas de un GaN, lo que resulta en resultados realistas, incluso en escenarios complejos como generar contenido ocluido y formas deformantes mientras se adhieren a la rigidez del objeto.

Nuestras evaluaciones integrales, que abarcan comparaciones cualitativas y cuantitativas, destacan la superioridad de Draggan sobre los métodos existentes en tareas relacionadas con la manipulación de imágenes y el seguimiento de puntos. Además, demostramos sus capacidades para manipular imágenes del mundo real a través de la inversión de GaN, mostrando su potencial para diversas aplicaciones prácticas en el ámbito de la síntesis y control de contenido visual.