Última actualización 02-12-2024

Categoría:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

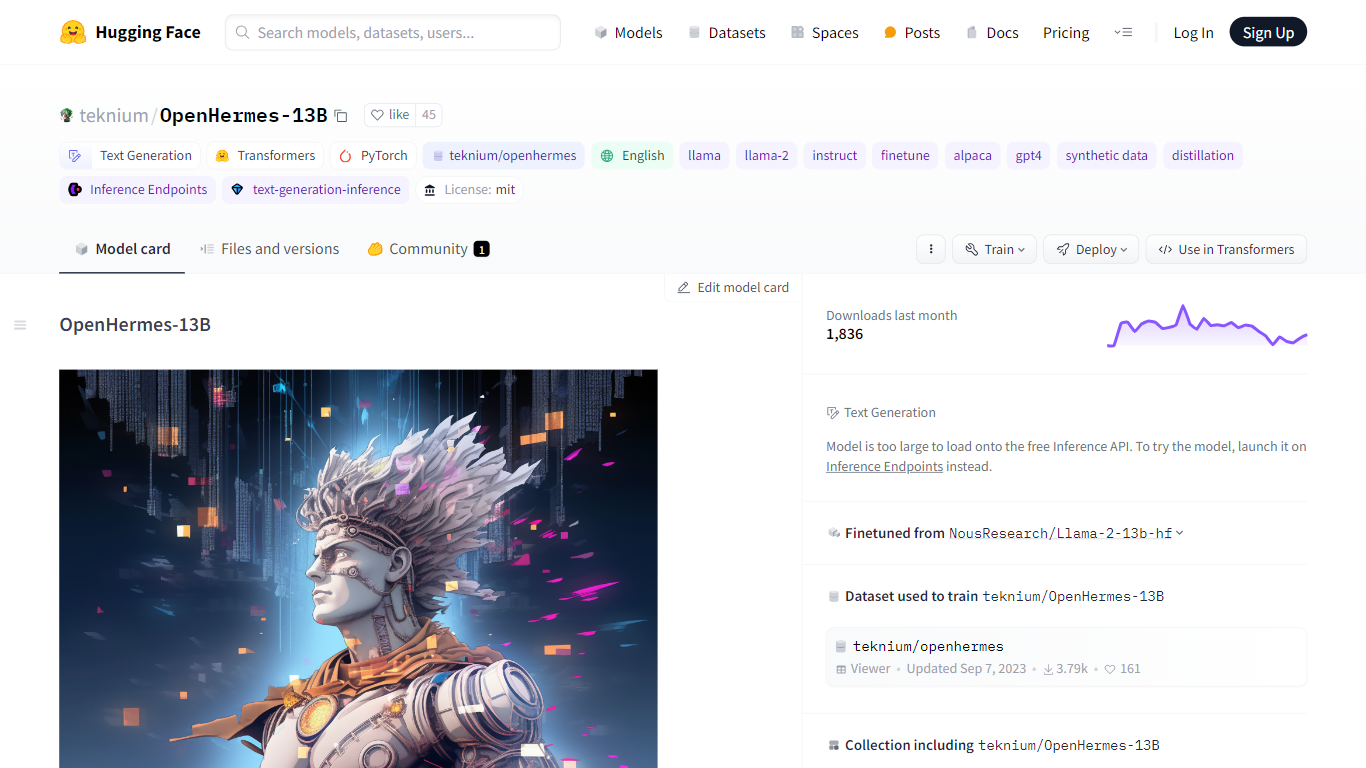

OpenHermes-13B

Descubra OpenHermes-13B, un modelo avanzado y optimizado de teknium que aprovecha el sólido conjunto de datos generado por GPT-4 recopilado de diversas soluciones de IA. OpenHermes-13B, meticulosamente entrenado en un conjunto de datos de código abierto que comprende 242 000 entradas, se diseñó utilizando contribuciones de líderes de la industria, incluidos Teknium, el equipo WizardLM y Microsoft, por nombrar algunos.

Este modelo tiene como objetivo mejorar la generación de texto a través de conjuntos de datos abiertos, diseñados específicamente para eliminar las exenciones de responsabilidad y las negativas de la IA para optimizar los resultados de la comunicación. Su proceso de capacitación, facilitado por el patrocinio de a16z y los recursos informáticos de main_horse, adopta la transparencia al permitir el acceso público al Proyecto WANDB. Sumérjase en los impresionantes resultados comparativos del modelo, su comparación de puntuación promedio con modelos similares y explore los hiperparámetros particulares que han dado forma a su entrenamiento.

Conjunto de datos de capacitación avanzada: Aprovechó el conjunto de datos de Hermes con ajustes en los datos generados por GPT-4 en todo el panorama de la IA.

Contribución de código abierto: Enfatizó un enfoque de código abierto con conjuntos de datos de múltiples contribuyentes de la industria de la IA.

Filtrado estratégico: Se eliminó contenido específico, como rechazos y exenciones de responsabilidad de OpenAI, para mejorar la calidad de la salida.

Análisis de rendimiento comparativo: Se mostraron resultados comparativos en diferentes suites como GPT4ALL, BigBench y AGI-Eval.

Procedimiento de capacitación transparente: Detalla el proceso de capacitación con registros del proyecto WANDB disponibles públicamente.

¿Qué es OpenHermes-13B?

OpenHermes-13B es un modelo de IA muy avanzado optimizado en conjuntos de datos generados principalmente por GPT-4, desarrollado por teknium y disponible a través de Hugging Face.

¿Qué conjuntos de datos se utilizaron en el entrenamiento de OpenHermes-13B?

El modelo se entrenó con contribuciones de conjuntos de datos de GPTeacher, Airoboros, Camel-AI, CodeAlpaca, WizardLM y los conjuntos de datos GPT4-LLM y Unnatural Directions de Microsoft.

¿Es público el proyecto WANDB para OpenHermes-13B?

Sí, el Proyecto WANDB está disponible públicamente y puede examinarse para comprender el proceso de capacitación y desarrollo de OpenHermes-13B.

¿Quién patrocinó el desarrollo de OpenHermes-13B?

El desarrollo de OpenHermes-13B fue patrocinado por a16z y respaldado con acceso informático por main_horse.

¿Qué mejoras presenta OpenHermes-13B respecto a modelos anteriores?

OpenHermes-13B ha mostrado una ligera mejora en puntos de referencia como GPT4ALL Suite y BigBench Suite, con cierta degradación en AGIEval en comparación con el modelo Hermes original.