UniLM vs ggml.ai

Dans le choc de UniLM vs ggml.ai, quel outil AI Large Language Model (LLM) émerge victorieux? Nous évaluons les avis, les prix, les alternatives, les fonctionnalités, les votes positifs, et plus encore.

Quand nous mettons UniLM et ggml.ai côte à côte, lequel émerge comme le vainqueur?

Prenons un plus près regard sur UniLM et ggml.ai, tous deux étant des outils large language model (llm) alimentés par l'IA, et voyons ce qui les distingue. Fait intéressant, les deux outils ont réussi à obtenir le même nombre de votes positifs. Puisque d'autres utilisateurs de aitools.fyi pourraient décider du gagnant, c'est maintenant à vous de jouer pour voter et nous aider à déterminer le gagnant.

Vous vous sentez rebelle? Votez et secouez les choses!

UniLM

Qu'est-ce que UniLM?

Cet article présente UniLM, un modèle de langage unifié pré-entraîné, qui sert de nouvelle référence pour les tâches de compréhension du langage naturel (NLU) et de génération du langage naturel (NLG). Il est unique dans son utilisation d'un réseau Transformer partagé qui est pré-entraîné sur des tâches unidirectionnelles, bidirectionnelles et séquence à séquence, utilisant des masques d'auto-attention spéciaux pour le contrôle de prédiction contextuel. UniLM surpasse BERT dans le benchmark GLUE et excelle dans les réponses aux questions SQuAD 2.0 et CoQA, établissant de nouveaux records dans cinq ensembles de données NLG, y compris des améliorations notables dans les tâches de synthèse CNN/DailyMail et Gigaword. Les modèles et le code partagés par les auteurs aident la communauté des chercheurs à progresser davantage.

ggml.ai

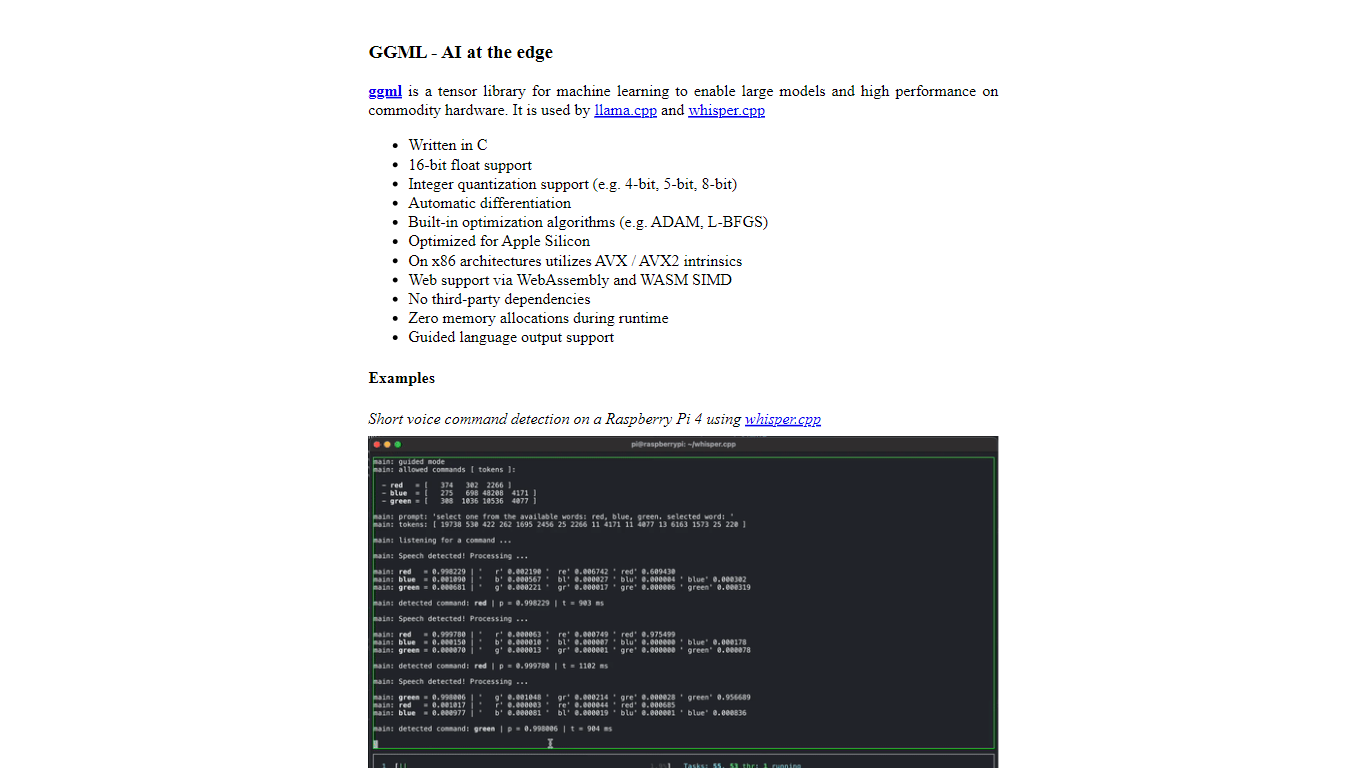

Qu'est-ce que ggml.ai?

ggml.ai est à la pointe de la technologie de l'IA, apportant de puissantes capacités d'apprentissage automatique directement à la périphérie grâce à sa bibliothèque de tenseurs innovante. Conçu pour la prise en charge de grands modèles et des performances élevées sur les plates-formes matérielles courantes, ggml.ai permet aux développeurs d'implémenter des algorithmes d'IA avancés sans avoir besoin d'équipement spécialisé. La plate-forme, écrite dans le langage de programmation C efficace, offre une prise en charge de la quantification flottante et entière 16 bits, ainsi que la différenciation automatique et divers algorithmes d'optimisation intégrés comme ADAM et L-BFGS. Il offre des performances optimisées pour Apple Silicon et exploite les intrinsèques AVX/AVX2 sur les architectures x86. Les applications basées sur le Web peuvent également exploiter ses capacités via la prise en charge de WebAssembly et WASM SIMD. Avec ses allocations de mémoire d'exécution nulles et son absence de dépendances tierces, ggml.ai présente une solution minimale et efficace pour l'inférence sur l'appareil.

Des projets tels que Whisper.cpp et Llama.cpp démontrent les capacités d'inférence hautes performances de ggml.ai, Whisper.cpp fournissant des solutions de synthèse vocale et Llama.cpp se concentrant sur l'inférence efficace du grand modèle de langage LLaMA de Meta. De plus, la société accueille favorablement les contributions à sa base de code et prend en charge un modèle de développement open-core via la licence MIT. Alors que ggml.ai continue de se développer, il recherche des développeurs à temps plein talentueux partageant une vision commune de l'inférence sur appareil pour rejoindre son équipe.

Conçu pour repousser les limites de l'IA à la pointe, ggml.ai témoigne de l'esprit de jeu et d'innovation de la communauté de l'IA.

UniLM Votes positifs

ggml.ai Votes positifs

UniLM Fonctionnalités principales

Pré-formation complète : UniLM est pré-formé aux tâches de modélisation de langage unidirectionnelles, bidirectionnelles et séquence à séquence.

Conception à double usage : Optimisé à la fois pour la compréhension et la génération du langage naturel, ce qui en fait un outil polyvalent en PNL.

Contrôle supérieur de l'auto-attention : Des masques d'auto-attention uniques dans le réseau Transformer partagé permettent des prédictions spécifiques au contexte.

Excellence de référence : Permet d'obtenir de nouveaux résultats de pointe sur plusieurs références, surpassant les modèles précédents comme BERT.

Contribution Open Source : Les auteurs donnent accès à des modèles et du code pré-entraînés pour une utilisation et une amélioration par la communauté.

ggml.ai Fonctionnalités principales

Écrit en C : Garantit des performances élevées et une compatibilité sur une gamme de plates-formes.

Optimisation pour Apple Silicon : Offre un traitement efficace et une latence réduite sur les appareils Apple.

Prise en charge de WebAssembly et WASM SIMD : Facilite l'utilisation des applications Web par les capacités d'apprentissage automatique.

Aucune dépendance tierce : Permet une base de code épurée et un déploiement pratique.

Prise en charge de la sortie linguistique guidée : Améliore l'interaction homme-machine avec des réponses plus intuitives générées par l'IA.

UniLM Catégorie

- Large Language Model (LLM)

ggml.ai Catégorie

- Large Language Model (LLM)

UniLM Type de tarification

- Freemium

ggml.ai Type de tarification

- Freemium