Dernière mise à jour 02-12-2024

Catégorie:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

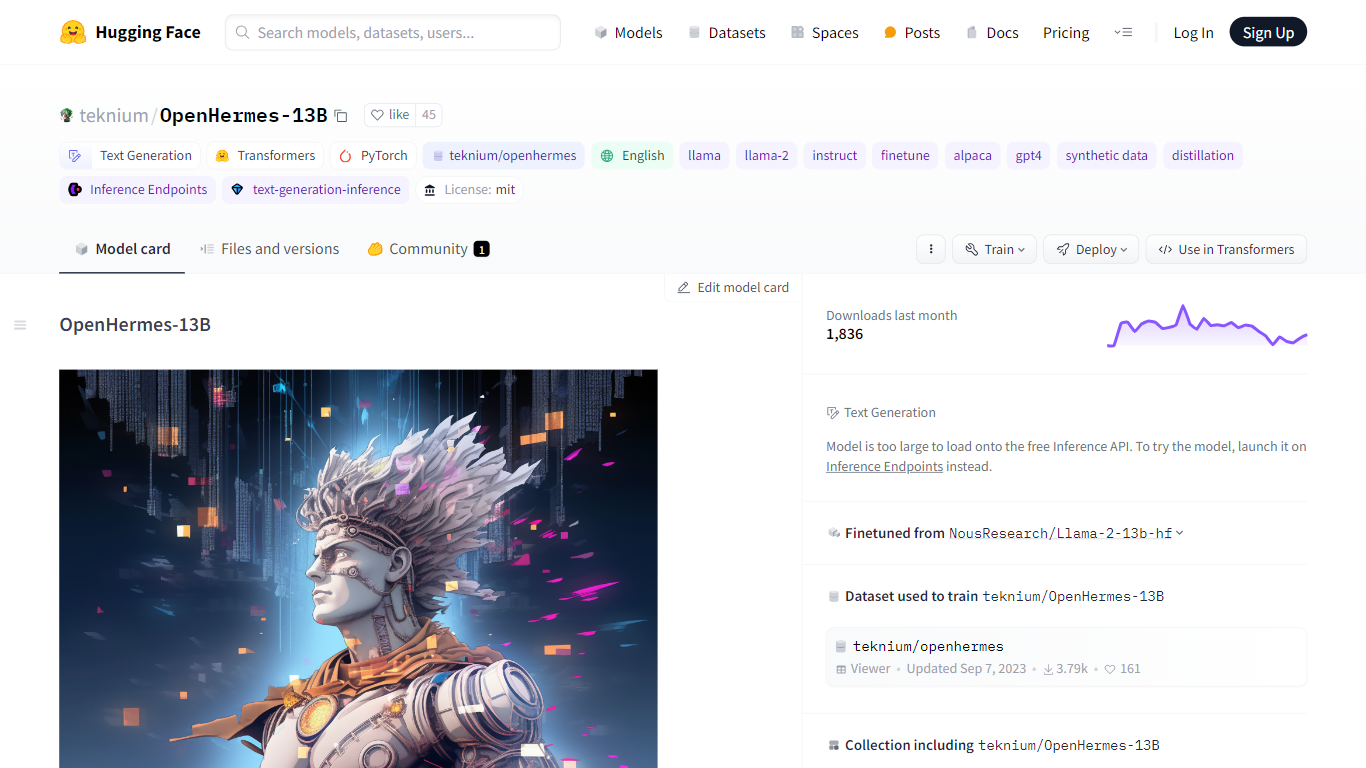

OpenHermes-13B

Découvrez OpenHermes-13B, un modèle avancé et affiné de Teknium qui exploite l'ensemble de données robuste généré par GPT-4 et collecté à partir de diverses solutions d'IA. Méticuleusement formé sur un ensemble de données entièrement open source comprenant 242 000 entrées, OpenHermes-13B a été conçu à l'aide des contributions de leaders du secteur, notamment Teknium, l'équipe WizardLM et Microsoft, pour n'en nommer que quelques-uns.

Ce modèle vise à améliorer la génération de texte via des ensembles de données ouverts, spécifiquement conçus pour supprimer les avertissements et les refus de l'IA afin de rationaliser les résultats de communication. Son processus de formation, facilité par le parrainage d'a16z et les ressources de calcul de main_horse, privilégie la transparence en permettant l'accès public au projet WANDB. Plongez dans les résultats de référence impressionnants du modèle, sa comparaison de scores moyens avec des modèles similaires et explorez les hyperparamètres particuliers qui ont façonné sa formation.

Ensemble de données de formation avancée : Exploitation de l'ensemble de données Hermes en affinant les données générées par GPT-4 dans le paysage de l'IA.

Contribution Open Source : Nous avons mis l'accent sur une approche open source avec des ensembles de données provenant de plusieurs contributeurs de l'industrie de l'IA.

Filtrage stratégique : Suppression de contenus spécifiques tels que les refus et les avertissements OpenAI pour améliorer la qualité de sortie.

Analyse des performances de référence : Présentation des résultats de référence dans différentes suites telles que GPT4ALL, BigBench et AGI-Eval.

Procédure de formation transparente : Détaillez le processus de formation avec les journaux du projet WANDB accessibles au public.

Qu’est-ce qu’OpenHermes-13B ?

OpenHermes-13B est un modèle d'IA très avancé, affiné sur des ensembles de données principalement générés par GPT-4, développé par teknium et disponible via Hugging Face.

Quels ensembles de données ont été utilisés dans la formation OpenHermes-13B ?

Le modèle a été formé sur les contributions aux ensembles de données GPTeacher, Airoboros, Camel-AI, CodeAlpaca, WizardLM et les ensembles de données GPT4-LLM et Unnatural Instructions de Microsoft.

Le projet WANDB pour OpenHermes-13B est-il public ?

Oui, le projet WANDB est accessible au public et peut être examiné pour comprendre le processus de formation et de développement d'OpenHermes-13B.

Qui a sponsorisé le développement d’OpenHermes-13B ?

Le développement d'OpenHermes-13B a été sponsorisé par a16z et pris en charge avec l'accès au calcul par main_horse.

Quelles améliorations OpenHermes-13B apporte-t-il par rapport aux modèles précédents ?

OpenHermes-13B a montré une légère amélioration dans les benchmarks comme GPT4ALL Suite et BigBench Suite, avec une certaine dégradation dans AGIEval par rapport au modèle Hermes original.