ALBERT vs ggml.ai

Mergulhe na comparação entre ALBERT vs ggml.ai e descubra qual ferramenta AI Large Language Model (LLM) se destaca. Examinamos alternativas, votos positivos, recursos, avaliações, preços e muito mais.

Ao comparar ALBERT e ggml.ai, qual se destaca?

Ao comparar ALBERT e ggml.ai, duas ferramentas excepcionais da categoria de large language model (llm) alimentadas por inteligência artificial, e colocá-las lado a lado, várias semelhanças e diferenças-chave se destacam. O número de votos positivos está acirrado tanto para ALBERT quanto para ggml.ai. O poder está em suas mãos! Vote e participe da decisão do vencedor.

Quer mudar o jogo? Vote em sua ferramenta favorita e mude a história!

ALBERT

O que é ALBERT?

ALBERT, abreviação de "A Lite BERT", é uma versão otimizada do modelo BERT amplamente utilizado para tarefas de processamento de linguagem natural. Apresentado no artigo arXiv de Zhenzhong Lan e colegas, ALBERT oferece duas técnicas de redução de parâmetros que diminuem significativamente o consumo de memória e aumentam a velocidade de treinamento do BERT sem sacrificar o desempenho.

Esse avanço aborda o desafio das limitações de memória GPU/TPU e dos tempos de treinamento normalmente longos associados ao aumento do tamanho dos modelos. O artigo demonstra, por meio de evidências empíricas, que o ALBERT não apenas tem um desempenho melhor que o BERT em uma variedade de benchmarks, como GLUE, RACE e SQuAD, mas também alcança resultados de última geração com uma contagem menor de parâmetros. A pesquisa introduz ainda uma função de perda auto-supervisionada que aumenta a capacidade do modelo de compreender a coerência entre frases, levando a uma melhoria substancial em tarefas que exigem entradas de várias frases. Os autores fornecem o código e os modelos pré-treinados para ALBERT, tornando-os acessíveis para uso generalizado na comunidade de PNL.

ggml.ai

O que é ggml.ai?

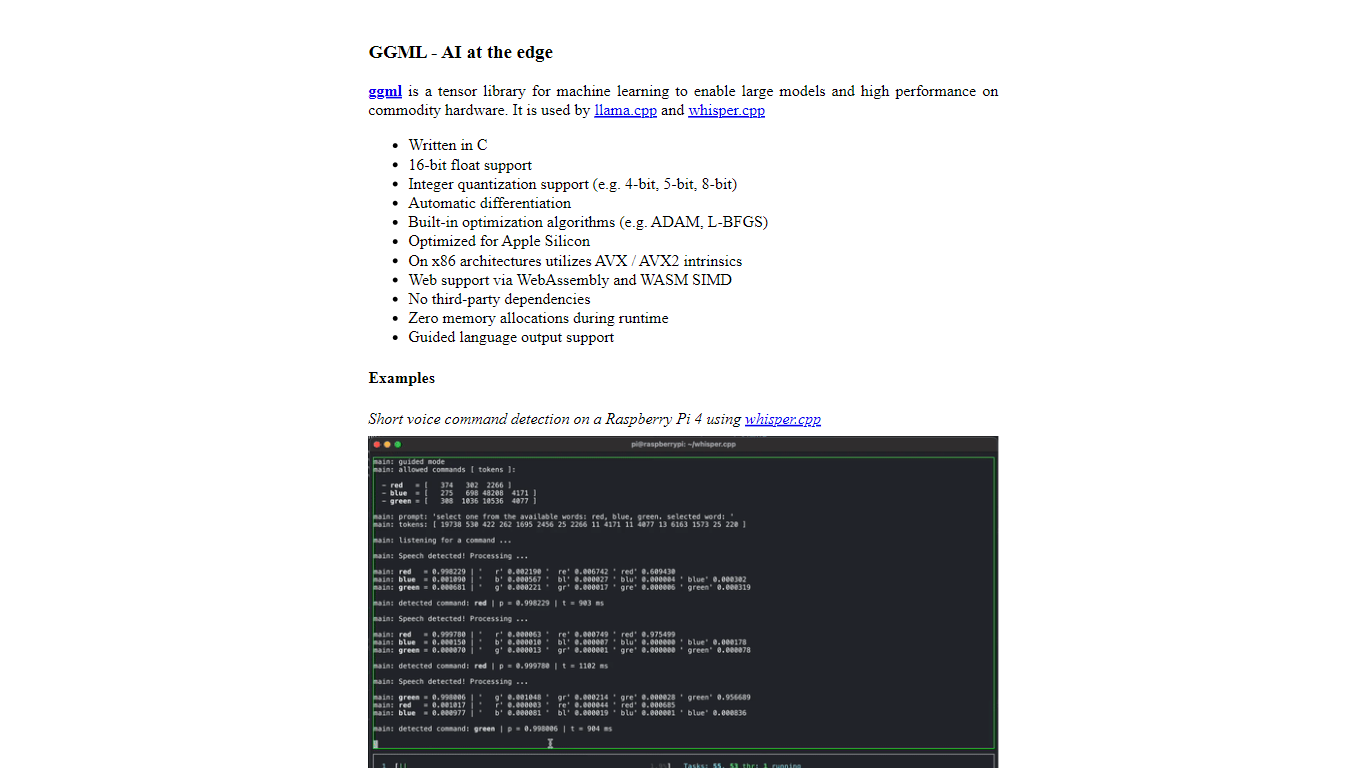

ggml.ai está na vanguarda da tecnologia de IA, trazendo poderosos recursos de aprendizado de máquina diretamente para o limite com sua inovadora biblioteca de tensores. Construído para suporte a grandes modelos e alto desempenho em plataformas de hardware comuns, ggml.ai permite que os desenvolvedores implementem algoritmos avançados de IA sem a necessidade de equipamento especializado. A plataforma, escrita na eficiente linguagem de programação C, oferece suporte para flutuação de 16 bits e quantização de inteiros, juntamente com diferenciação automática e vários algoritmos de otimização integrados, como ADAM e L-BFGS. Possui desempenho otimizado para Apple Silicon e aproveita os intrínsecos AVX/AVX2 em arquiteturas x86. Os aplicativos baseados na Web também podem explorar seus recursos por meio do suporte WebAssembly e WASM SIMD. Com zero alocações de memória em tempo de execução e ausência de dependências de terceiros, ggml.ai apresenta uma solução mínima e eficiente para inferência no dispositivo.

Projetos como whisk.cpp e llama.cpp demonstram os recursos de inferência de alto desempenho do ggml.ai, com o whisker.cpp fornecendo soluções de fala para texto e o llama.cpp focando na inferência eficiente do modelo de linguagem grande LLaMA da Meta. Além disso, a empresa aceita contribuições para a sua base de código e apoia um modelo de desenvolvimento de núcleo aberto através da licença MIT. À medida que a ggml.ai continua a se expandir, ela procura desenvolvedores talentosos em tempo integral com uma visão compartilhada de inferência no dispositivo para se juntarem à sua equipe.

Projetado para ir além dos limites da IA, ggml.ai é uma prova do espírito de diversão e inovação na comunidade de IA.

ALBERT Votos positivos

ggml.ai Votos positivos

ALBERT Recursos principais

Técnicas de redução de parâmetros: Técnicas que reduzem o consumo de memória e aumentam a velocidade de treinamento do BERT.

Escalonamento de modelo aprimorado: ALBERT é melhor dimensionado que o BERT original, mesmo com menos parâmetros.

Desempenho de última geração: As conquistas incluem novas pontuações altas nos benchmarks GLUE, RACE e SQuAD.

Função de perda auto-supervisionada: Uma nova função de perda que melhora a modelagem da coerência entre frases.

Modelos de código aberto: os modelos pré-treinados e a base de código estão disponíveis publicamente para uso da comunidade.

ggml.ai Recursos principais

Escrito em C: Garante alto desempenho e compatibilidade em diversas plataformas.

Otimização para Apple Silicon: oferece processamento eficiente e menor latência em dispositivos Apple.

Suporte para WebAssembly e WASM SIMD: Facilita que aplicativos Web utilizem recursos de aprendizado de máquina.

Sem dependências de terceiros: Proporciona uma base de código organizada e uma implantação conveniente.

Suporte de saída de idioma guiado: Melhora a interação humano-computador com respostas mais intuitivas geradas por IA.

ALBERT Categoria

- Large Language Model (LLM)

ggml.ai Categoria

- Large Language Model (LLM)

ALBERT Tipo de tarifação

- Freemium

ggml.ai Tipo de tarifação

- Freemium