Chinchilla vs Terracotta

En el enfrentamiento entre Chinchilla vs Terracotta, ¿cuál herramienta AI Large Language Model (LLM) se lleva la corona? Escrutamos características, alternativas, votos positivos, opiniones, precios, y más.

Cuando ponemos a Chinchilla y Terracotta cara a cara, ¿cuál emerge como el vencedor?

Si analizáramos Chinchilla y Terracotta, ambas herramientas son impulsadas por inteligencia artificial en la categoría de large language model (llm), ¿qué encontraríamos? El conteo de votos positivos está muy parejo para tanto Chinchilla como Terracotta. Puedes ayudarnos a determinar al ganador emitiendo tu voto y inclinando la balanza a favor de una de las herramientas.

¿Te sientes rebelde? ¡Emite tu voto y sacude las cosas!

Chinchilla

¿Qué es Chinchilla?

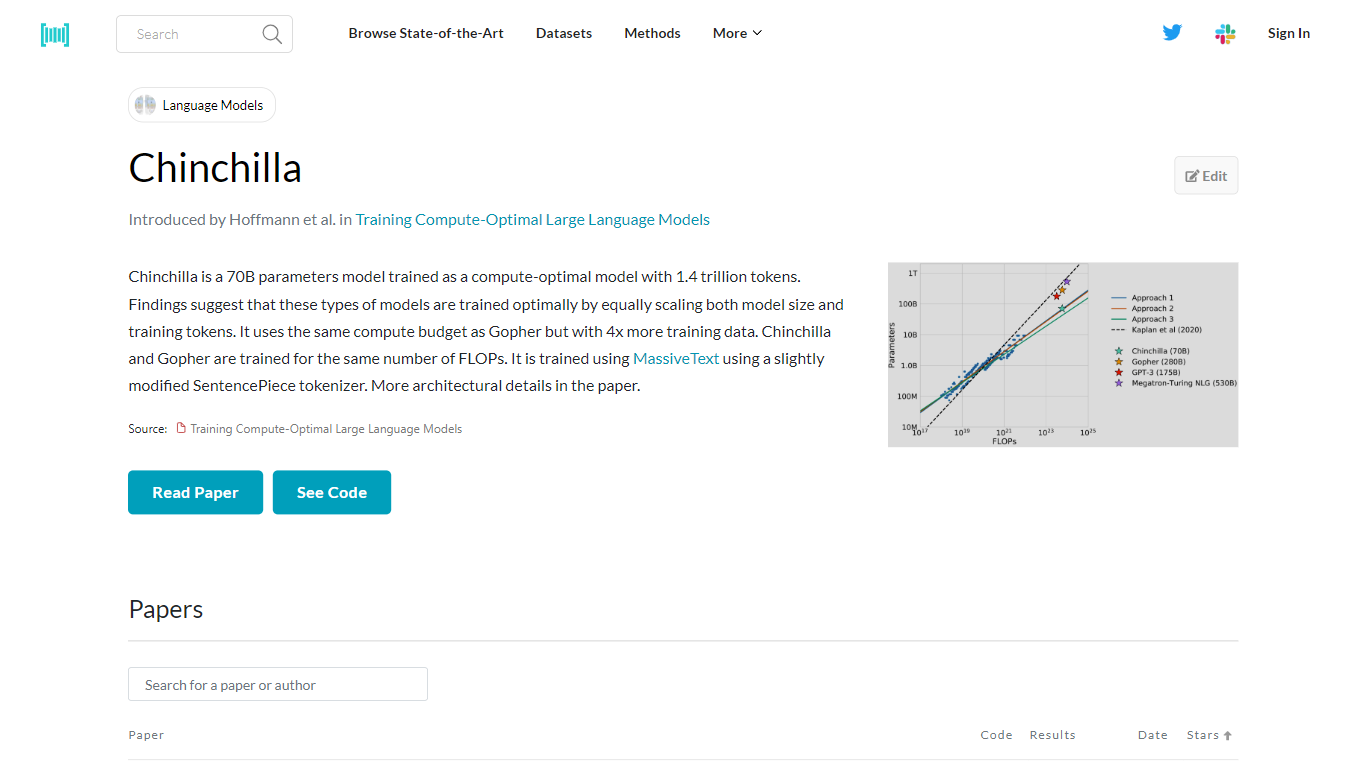

Chinchilla es un modelo avanzado de inteligencia artificial con 70 mil millones de parámetros, desarrollado para optimizar tanto el tamaño del modelo como el volumen de datos de entrenamiento para un aprendizaje eficiente. Fue entrenado utilizando la extraordinaria cantidad de 1,4 billones de tokens, con énfasis en escalar el modelo y los datos proporcionalmente. Este método de entrenamiento se basa en investigaciones que sugieren que el entrenamiento óptimo ocurre cuando el tamaño del modelo y los tokens de entrenamiento aumentan en conjunto. Chinchilla comparte su presupuesto de computación con otro modelo llamado Gopher, pero se distingue por aprovechar cuatro veces más datos de entrenamiento. A pesar de esta diferencia, ambos modelos están diseñados para funcionar con la misma cantidad de FLOP, lo que garantiza una utilización eficiente de los recursos informáticos. Chinchilla aprovecha MassiveText, un vasto conjunto de datos, y emplea una adaptación del tokenizador SentencePieza para interpretar y procesar datos. Para una comprensión detallada de su arquitectura y formación, se puede consultar el artículo que detalla estos aspectos.

Terracotta

¿Qué es Terracotta?

Terracotta es una plataforma de vanguardia diseñada para mejorar el flujo de trabajo de desarrolladores e investigadores que trabajan con modelos de lenguajes grandes (LLM). Esta plataforma intuitiva y fácil de usar le permite administrar, iterar y evaluar sus modelos ajustados con facilidad. Con Terracotta, puede cargar datos de forma segura, ajustar modelos para diversas tareas como clasificación y generación de texto, y crear evaluaciones integrales para comparar el rendimiento del modelo utilizando métricas tanto cualitativas como cuantitativas. Nuestra herramienta admite conexiones con proveedores importantes como OpenAI y Cohere, lo que garantiza que tenga acceso a una amplia gama de capacidades de LLM. Terracotta es la creación de Beri Kohen y Lucas Pauker, entusiastas de la IA y graduados de Stanford, que se dedican a promover el desarrollo de LLM. Únase a nuestra lista de correo electrónico para mantenerse informado sobre las últimas actualizaciones y características que Terracotta tiene para ofrecer.

Chinchilla Votos positivos

Terracotta Votos positivos

Chinchilla Características principales

Entrenamiento óptimo en computación: Un modelo de parámetros de 70 B entrenado con un enfoque en el escalado ideal del tamaño del modelo y los datos de entrenamiento.

Amplios datos de capacitación: Utiliza 1,4 billones de tokens, lo que indica un conjunto de datos rico y diverso para un aprendizaje en profundidad.

Recursos informáticos equilibrados: Coincide con el presupuesto informático de Gopher y ofrece 4 veces la cantidad de datos de entrenamiento.

Asignación eficiente de recursos: Mantiene la capacitación bajo el mismo número de FLOP que su contraparte, Gopher.

Utilización de MassiveText: Entrena utilizando un tokenizador SentencePieza ligeramente modificado en el conjunto de datos de MassiveText, lo que proporciona un amplio corpus para el aprendizaje de modelos.

Terracotta Características principales

Administre muchos modelos: Maneje centralmente todos sus modelos ajustados en un lugar conveniente.

Itere rápidamente: Optimice el proceso de mejora del modelo con evaluaciones cualitativas y cuantitativas rápidas.

Múltiples proveedores: Integre perfectamente con los servicios de OpenAI y Cohere para potenciar su proceso de desarrollo.

Cargue sus datos: Cargue y almacene de forma segura sus conjuntos de datos para ajustar los modelos.

Crear evaluaciones: Realice evaluaciones comparativas en profundidad del rendimiento del modelo aprovechando métricas como la precisión BLEU y las matrices de confusión.

Chinchilla Categoría

- Large Language Model (LLM)

Terracotta Categoría

- Large Language Model (LLM)

Chinchilla Tipo de tarificación

- Freemium

Terracotta Tipo de tarificación

- Freemium