Última actualización 02-12-2024

Categoría:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

phi-2

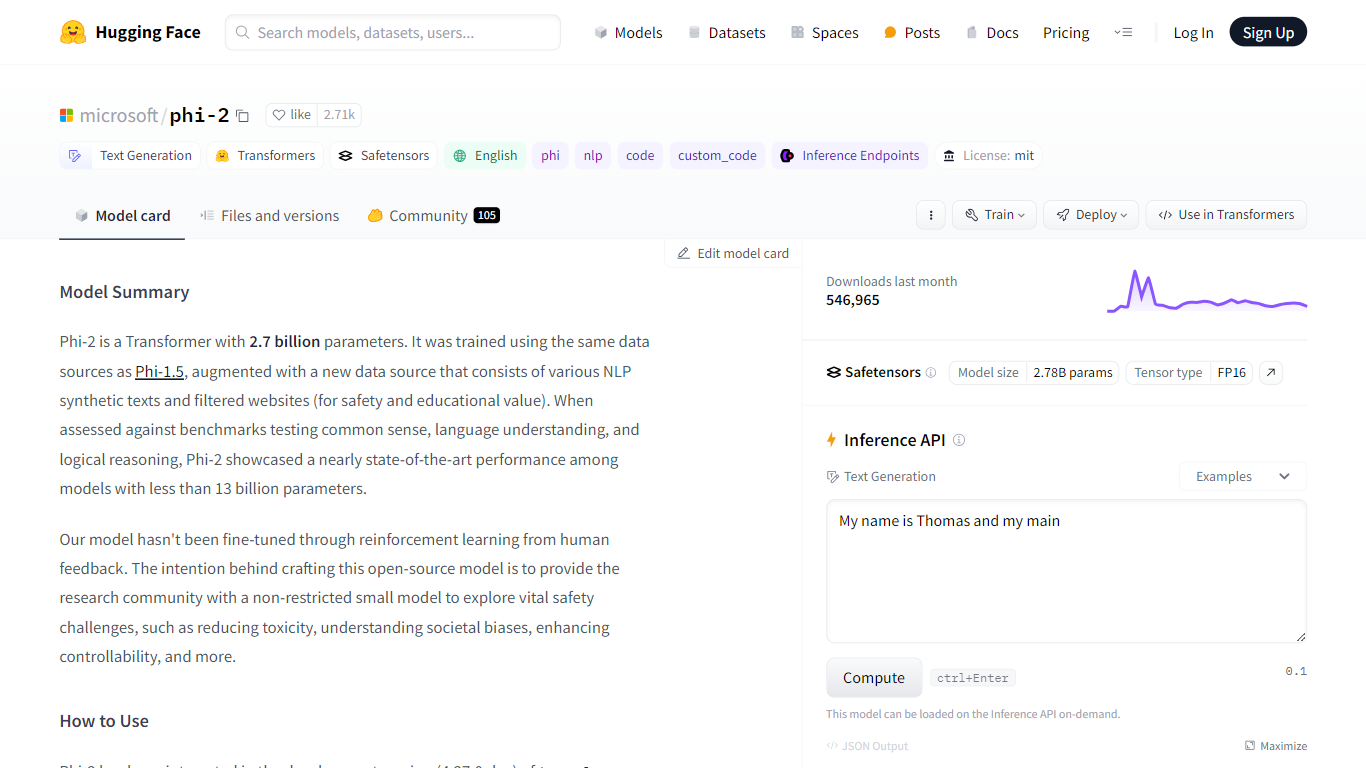

Phi-2 de Microsoft, alojado en Hugging Face, representa un salto adelante en el campo de la inteligencia artificial con sus sustanciales 2.700 millones de parámetros. El modelo basado en Transformer, Phi-2, fue entrenado meticulosamente en un conjunto de datos diverso que abarca tanto textos sintéticos de PNL como fuentes web cuidadosamente filtradas para garantizar la seguridad y el valor educativo. Phi-2 sobresale en los puntos de referencia de sentido común, comprensión del lenguaje y razonamiento lógico, estableciendo un alto estándar para los modelos de su clase.

Esta herramienta de vanguardia está diseñada principalmente para la generación de texto en inglés, lo que proporciona un recurso potente para tareas de codificación y PNL. A pesar de sus capacidades, se recomienda Phi-2 como base para un mayor desarrollo en lugar de una solución llave en mano, y se anima a los usuarios a estar atentos a posibles sesgos y verificar la precisión de los resultados. El modelo está disponible para integración con la última biblioteca de transformadores y lleva la licencia permisiva del MIT, lo que promueve la ciencia abierta y la democratización de la IA.

Arquitectura del modelo: Phi-2 es un modelo basado en Transformer con 2,7 mil millones de parámetros, conocido por su desempeño en la comprensión del lenguaje y el razonamiento lógico.

Cómo utilizar: Los usuarios pueden integrar Phi-2 con la versión de desarrollo de la biblioteca de transformadores asegurándose de que se utilice

trust_remote_code=Truey verificando la versión correcta de los transformadores.Usos previstos: Ideal para formatos de control de calidad, chat y código, Phi-2 es versátil para diversas indicaciones, aunque sus resultados deben verse como puntos de partida para el refinamiento del usuario.

Limitaciones y precauciones: Si bien es poderoso, Phi-2 tiene sus limitaciones, como posible generación de códigos o hechos inexactos, sesgos sociales y verbosidad, que los usuarios deben tener en cuenta.

Entrenamiento y conjunto de datos: El modelo se entrenó en un colosal conjunto de datos de tokens de 250 mil millones, utilizando GPU 96xA100-80G durante dos semanas, lo que demuestra su destreza técnica.

1) ¿Qué es Phi-2?

Phi-2 es un modelo Transformer que destaca en sentido común, comprensión del lenguaje y razonamiento lógico con 2.700 millones de parámetros.

2) ¿Cómo se pretende utilizar Phi-2?

El modelo es más adecuado para formatos de control de calidad, chat y código, y puede integrarse con la biblioteca de transformadores.

3) ¿Cuáles son las limitaciones de Phi-2?

A pesar de una capacitación exhaustiva, el modelo puede generar código o hechos inexactos, y los usuarios deben considerar los resultados como sugerencias.

4) ¿Se ha perfeccionado Phi-2?

Phi-2 no ha sido ajustado con comentarios humanos, pero está disponible para su integración con la versión de desarrollo (4.37.0.dev) de Transformers.

5) ¿Phi-2 está disponible para uso de código abierto?

Sí, el modelo tiene la licencia MIT, lo que promueve las contribuciones de la comunidad científica abierta y de código abierto.