Última actualización 02-10-2024

Categoría:

Reviews:

Join thousands of AI enthusiasts in the World of AI!

Chain of Thought Prompting

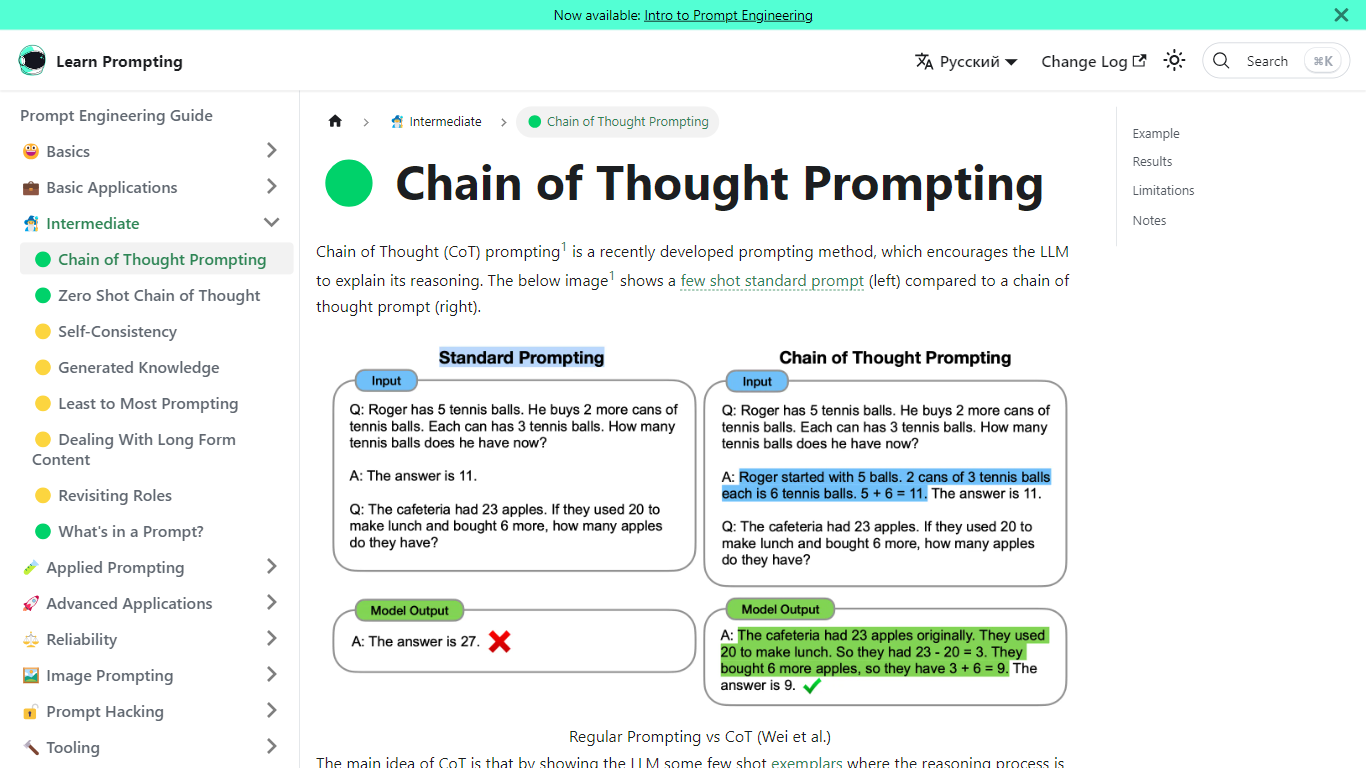

Chain of Thought Prompting es un enfoque innovador para mejorar la interacción con modelos de lenguaje grandes (LLM), permitiéndoles proporcionar explicaciones detalladas de sus procesos de razonamiento. Este método, destacado en el trabajo de Wei et al., muestra una promesa considerable a la hora de mejorar la precisión de las respuestas de la IA en diversas tareas como la aritmética, la comprensión del sentido común y el razonamiento simbólico. A través de ejemplos y análisis comparativos, los lectores pueden comprender las ventajas de este enfoque, especialmente cuando se aplica a modelos más grandes con alrededor de 100 mil millones de parámetros o más. Sin embargo, se observa que los modelos más pequeños no se benefician tanto y pueden producir resultados menos lógicos. El contenido ofrece información sobre las complejidades y limitaciones de la técnica, lo que la convierte en un recurso valioso para cualquiera que busque profundizar en el mundo de la IA y la ingeniería rápida.

Precisión mejorada: La cadena de estimulación del pensamiento conduce a resultados más precisos en las tareas de IA.

Explicación del razonamiento: Alienta a los LLM a detallar su proceso de pensamiento.

Eficaz para modelos grandes: Las mejores ganancias de rendimiento con modelos de aprox. Parámetros 100B.

Análisis comparativo: Resultados comparativos, incluido el rendimiento comparativo de GSM8K.

Ejemplos prácticos: Demostraciones de indicaciones de CoT con GPT-3.

1) ¿Qué es la cadena de pensamiento que incita?

Chain of Thought Prompting es un método que hace que los modelos de IA expliquen su razonamiento, lo que a menudo resulta en tareas de IA más precisas, como el razonamiento aritmético y de sentido común.

2) ¿Qué modelos se benefician más de la cadena de estímulos del pensamiento?

Es particularmente eficaz cuando se utiliza con modelos de lenguaje grandes de alrededor de 100 mil millones de parámetros, como se ve con el PaLM 540B.

3) ¿Cómo funciona la cadena de estímulos del pensamiento?

Alienta al modelo de IA a mostrar su razonamiento paso a paso mediante el uso de ejemplos de pocas tomas donde el proceso de razonamiento se explica claramente.

4) ¿Existe alguna limitación para la cadena de estímulos del pensamiento?

Según la investigación de Wei et al., los modelos más pequeños pueden generar cadenas de pensamiento menos lógicas, lo que lleva a un peor rendimiento en comparación con los métodos de estimulación estándar.

5) ¿Hay cursos disponibles para aprender sobre ingeniería rápida?

Sí, puede unirse a los cursos Introducción a la ingeniería de indicaciones y Ingeniería avanzada de indicaciones para aprender más sobre cómo crear indicaciones eficientes.